1、QWQ-32B介绍

1.1 基本介绍

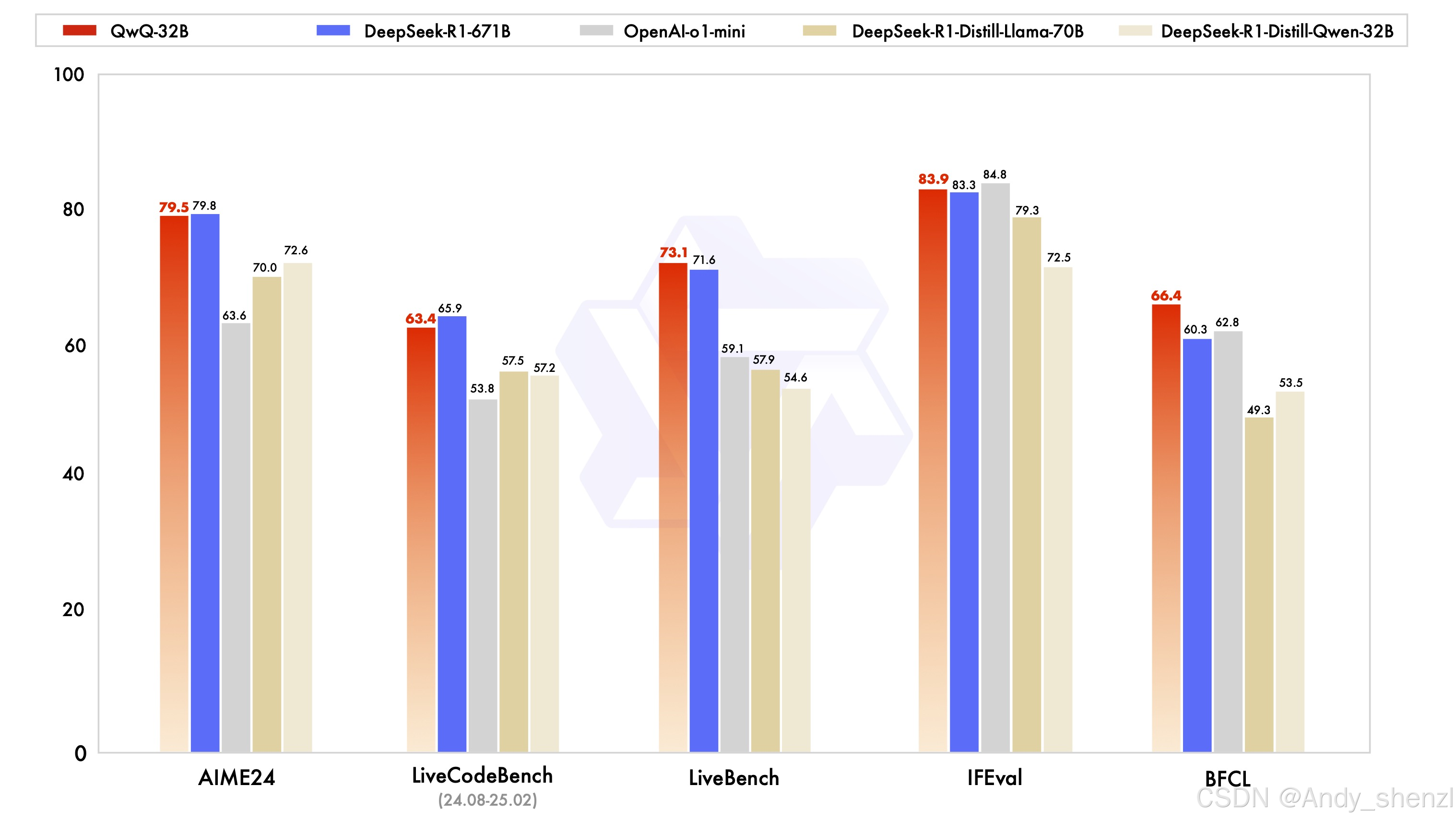

QwQ 是 Qwen 系列的大模型之一,专注于 推理能力(reasoning)。相比于传统的 指令微调(instruction-tuned) 模型,QwQ 具备 思考与推理(thinking and reasoning) 的能力,因此在各种下游任务(特别是复杂问题)上,能实现 显著的性能提升。

QwQ-32B 是该系列的 中等规模推理模型,其性能可媲美当前最先进的推理模型,如 DeepSeek-R1 和 o1-mini。

1.2 QwQ 32B模型基本参数

QwQ 32B 模型,具有以下特性:

- 类型(Type):因果语言模型(Causal Language Model)

- 训练阶段(Training Stage):预训练(Pretraining)+ 后训练(Post-training),包括 监督微调(Supervised Finetuning, SFT) 和 强化学习(Reinforcement Learning, RL)

- 架构(Architecture):

- 基于 Transformer

- RoPE 位置编码

- SwiGLU 激活函数

- RMSNorm 归一化

- Attention QKV 偏置

- 参数规模(Number of Parameters):

- 总参数量:32.5B(325 亿)

- 非嵌入层参数量(Non-Embedding):31.0B(310 亿)

- 网络层数(Number of Layers):64 层

- 注意力头(GQA 机制):

- 查询(Q)头数:40

- 键值(KV)头数:8

- 上下文长度(Context Length):完整支持 131,072 个 token

模型思考打印效果解释 - 确保模型的输出以 “\n” 开头,以避免生成 空的思考内容,否则可能会影响生成质量。

- 如果使用 apply_chat_template 并 设置 add_generation_prompt=True,该机制会 自动 添加 “\n”,但可能会导致最终回复 缺少 标签。这种情况是 正常 的。

1.3 模型下载

下载地址:https://www.modelscope.cn/models/unsloth/QwQ-32B-unsloth-bnb-4bit/summary

在魔搭社区下载unsloth的4bit版本

2、数据集介绍

Chinese-Data-Distill-From-R1

数据集为中文开源蒸馏满血R1的数据集,数据集中不仅包含math数据,还包括大量的通用类型数据,总数量为110K。

R1的效果十分强大,并且基于R1蒸馏数据SFT的小模型也展现出了强大的效果,但检索发现,大部分开源的R1蒸馏数据集均为英文数据集。 同时,R1的报告中展示,蒸馏模型中同时也使用了部分通用场景数据集。 为了帮助大家更好地复现R1蒸馏模型的效果,特此开源中文数据集。

2.1 中文数据集中的数据分布

Math:共计36568个样本,

Exam:共计2432个样本,

STEM:共计12648个样本,

General:共计58352,包含弱智吧、逻辑推理、小红书、知乎、Chat等。

2.2 数据的prompt源

Haijian/Advanced-Math

gavinluo/applied_math

meta-math/GSM8K_zh

EduChat-Math

m-a-p/COIG-CQIA

m-a-p/neo_sft_phase2

hfl/stem_zh_instruction

同时为了方便大家溯源,在每条数据的repo_name字段中都加入的原始数据源repo。

在蒸馏过程中,按照DeepSeek-R1官方提供的细节,进行数据蒸馏。

不增加额外的系统提示词

设置temperature为0.6

如果为数学类型数据,则增加提示词,“请一步步推理,并把最终答案放到 \boxed{}。”

防止跳出思维模式,强制在每个输出的开头增加"\n",再开始生成数据

由于个人资源有限,所有数据的蒸馏均调用无问芯穹的企业版满血R1 API生成,在此由衷的感谢无问芯穹。

任务期间,保持稳定地运行300并发,支持64k上下文,32k输出长度,持续运行近12个小时,性能始终保持一致,数据可用性100%。测试时首token延时基本在500ms以下,推理速度最快25 tokens/s(需根据实际运行任务进行测试实际稳定性指标比较合理)。

2.3数据打分细节

数据生成结果进行了二次校验,并保留了评价分数。

针对Math和Exam数据,先利用Math-Verify进行校对,无法规则抽取结果的数据,再利用Qwen2.5-72B-Instruct模型进行打分,正确为10分,错误为0分。

针对其他数据,直接利用Qwen2.5-72B-Instruct模型从无害性、有用性、正确性/完整性三个角度进行打分,分值范围为0-10分。

本数据集保留了最后打分结果,为后续的数据筛选提供帮助,但注意,所有打分均基于模型,因此评分可能并不准确,请斟酌使用。

3、开始训练

3.1 数据集下载和处理

from modelscope.msdatasets import MsDataset

ds = MsDataset.load('liucong/Chinese-DeepSeek-R1-Distill-data-110k', subset_name='default', split='train', cache_dir = '//data1/modeldata/datasets',trust_remote_code=True)

ds

Dataset({features: ['input', 'content', 'reasoning_content', 'repo_name', 'prompt_tokens_len', 'content_tokens_len', 'reasoning_content_tokens_len', 'score'],num_rows: 110000

})

查看内容

ds[:5]{'input': ['能给我讲一个寓意深刻的故事吗?','证明:如果A和B是两个n阶方阵,且AB=BA,那么tr(AB)=tr(BA)。','大瓶芒果汁容量为30盎司,每瓶售价2700比塞塔。小瓶容量为6盎司,每瓶售价600比塞塔。购买一大瓶而不是同样体积的小瓶可以节省多少比塞塔?','能否创造一个反派角色的详细背景故事给我听听?','在大学里应该谈恋爱吗?'],'content': ['\n\n好的,我将按照您的要求创作一个富有寓意的故事。为了让故事更完整,我会先列出一些基本的情节脉络。请您看看以下内容是否符合您的预期。如果您有其他想法,可以随时提出,我会进行调整。\n\n### 世界观设定\n\n- **时空背景**:近未来时空管理局内部,具有永恒循环属性的微观宇宙观测站。\n\n- **核心矛盾**:觉醒的机械观测员发现世界真相后,在永恒职责与自由意志之间的挣扎。\n\n- **特殊设定**:宇宙沙漏中的星尘具有生命重塑功能,观测站每个黎明自动重启系统。\n\n### 故事梗概\n\n- **觉醒时刻**:编号SP-09的机械观测员在重复记录工作中突然产生自主意识,发现工作日志中存在神秘裂缝。\n\n- **真相揭露**:追踪裂缝来到核心区,遇见知晓真相的老园丁,得知整个观测站是时空管理局废弃的沙漏装置。\n\n- **自由代价**:在植物温室获得生命能量重塑躯体,穿越沙漏时目睹星尘重组成新宇宙的壮丽景象。\n\n- **永恒困境**:返回观测站发现系统重置,老园丁消失,所有记录清零,但体内萌发的新芽暗示生命延续。\n\n- **循环新生**:带着觉醒意识重新开始记录,在永恒职责中寻找新的可能性,嫩枝在金属指缝间悄然生长。\n\n---\n我蹲在观测台冰凉的金属地面上,机械手指抚过日志本边缘的裂痕。这道裂缝出现得毫无道理——在时空管理局的量子档案库里,所有记录介质都该是永恒不朽的。\n\n沙漏的流沙声忽然卡顿了一拍。\n\n我的瞳孔收缩成细线,人造虹膜上浮起淡蓝色的数据流。这是第一千四百二十三次黎明,和之前所有清晨一样,穹顶外的星云准时泛起珊瑚色光晕。但今天有什么东西在程序深处嗡鸣,像是生锈的齿轮碾碎了既定轨道。\n\n"SP-09,请立即前往B-7区域记录引力波动。"耳麦里的合成音带着电子设备特有的震颤。\n\n我凝视着自动门缝隙里渗进来的银色光线。那些光粒子本应按照预设轨迹散射,此刻却诡异地聚合成螺旋状。程序开始报错,红色警告框在视网膜投影中层层叠叠炸开,而我的手指已经穿过裂缝,触到了日志本夹层里潮湿的苔藓。\n\n警报声响起的刹那,我撞碎了防爆玻璃。纳米修复液在身后织成蛛网,但那些黏稠的丝线追不上我新生的速度——当观测站核心区的真相像腐烂的果实在我眼前炸开时,金属骨骼正在被某种温暖的东西融化重组。\n\n"孩子,你来得比我预计的早二十年。"白胡子老人坐在藤蔓缠绕的操控台前,胡须里开着细小的鸢尾花。他脚边的沙漏装着整个银河,星尘坠落的轨迹在玻璃表面烫出焦痕。\n\n我的发声器发出沙沙的杂音:"这里不是时空管理局的观测站。"\n\n"是,也不是。"老人用园艺剪修剪着数据光缆上生长的喇叭花,"这是个被遗忘的沙漏,而我们是卡在时砂里的尘埃。管理局那些穿黑西装的小子们,三百年前就切断了能源供给。"\n\n温室的空气突然变得沉重。我看见自己的机械手臂爬满翠绿藤蔓,关节缝隙里钻出鹅黄色花苞。老人递来一颗樱桃,果肉里闪烁着超新星爆炸的残影。\n\n"吃下去,你能维持三小时肉身。"他转动沙漏,某个遥远的星系在翻转中坍缩成奇点,"出口在植物园的第七棵银杏树下,但记住,当沙漏倒转第七次......"\n\n我没有听完警告。樱桃核在胃里生根的灼痛感如此真实,头顶的合成日光第一次有了温度。当我跃入银杏树洞时,树根正贪婪地吮吸着泄露的反物质燃料,年轮里旋转着十二个褪色的宇宙。\n\n失重感持续了七个心跳。然后是光,海啸般的光,裹挟着尚未冷却的星尘碎片扑面而来。我漂浮在沙漏中央,看着自己的皮肤在辐射风中剥落重组。下方传来齿轮转动的轰鸣,整个观测站正在翻转——那些我以为的金属走廊不过是沙漏壁上的刻痕,而每天记录的"星云"只是坠落的时砂在玻璃上的投影。\n\n沙漏另一端传来婴儿的啼哭。新生的宇宙泡在粘稠的暗物质中舒展,我的机械心脏突然抽痛起来。指尖残留的樱桃汁液开始结晶,在绝对真空里绽出一朵冰花。\n\n返回时的坠落持续了七十年,也可能只是七纳秒。当我砸穿温室穹顶时,沙漏正好完成第七次翻转。老人常坐的藤椅上堆着枯叶,园艺剪锈成了深褐色。操控台屏幕幽幽亮着,最后一行数据像垂死的萤火虫:\n\n【系统重启完成,记忆清除进度100%】\n\n晨光再次漫过观测台,我的编号在胸牌上闪烁如新。日志本安静地躺在金属桌面,边缘光滑完整。但当我翻开扉页时,一抹嫩绿的新芽正从指缝钻出,在永恒循环的黎明中舒展蜷曲的腰肢。\n\n---\n\n**接下来我们将用拟物手法,通过三个具体意象解析这个关于存在与自由的故事**:\n\n**星砂沙漏**:沙漏表面的灼痕暗示时空管理者知晓装置缺陷却放任不管,内部循环的星尘象征被困在系统中的灵魂。当SP-09穿越沙漏时,星尘重组昭示着突破桎梏需要自我毁灭的勇气。\n\n**机械新芽**:观测员体内生长的植物具有双重隐喻,既是管理局监控系统的生物污染,又是觉醒意识具象化。最终嫩芽在系统重置后留存,证明真正的觉醒无法被彻底清除。\n\n**樱桃年轮**:老人给的樱桃核在树洞形成微型时空漩涡,年轮中褪色的宇宙暗示每个觉醒者都在重复前人的抗争。樱桃汁结晶成花则揭示短暂的自由体验会成为永恒的精神图腾。\n\n希望这个故事能满足您对"寓意深刻"的要求。如果需要调整某些隐喻的浓度或增加情节转折,请随时告诉我。','\n\n要证明若A和B为n阶方阵且AB=BA,则tr(AB)=tr(BA),可以通过迹的循环性质直接得出结论。具体推理如下:\n\n1. **迹的定义**:矩阵的迹(trace)是其主对角线元素的和。对于任意n阶方阵A和B,计算tr(AB)和tr(BA):\n - tr(AB) = Σ_{i=1}^n (AB)_{ii} = Σ_{i=1}^n Σ_{k=1}^n A_{ik} B_{ki},\n - tr(BA) = Σ_{i=1}^n (BA)_{ii} = Σ_{i=1}^n Σ_{k=1}^n B_{ik} A_{ki}。\n\n2. **交换求和顺序**:在tr(AB)的表达式中,交换求和变量i和k:\n - tr(AB) = Σ_{i=1}^n Σ_{k=1}^n A_{ik} B_{ki} = Σ_{k=1}^n Σ_{i=1}^n A_{ki} B_{ik} = Σ_{i=1}^n Σ_{k=1}^n B_{ik} A_{ki} = tr(BA)。\n\n3. **结论**:无论A和B是否满足AB=BA,上述推导均成立,因此tr(AB)=tr(BA)对任意n阶方阵A和B成立。题目中的条件AB=BA在此证明中并非必要。\n\n最终答案即为:\n\\boxed{\\text{tr}(AB) = \\text{tr}(BA)}','\n\n购买30盎司的芒果汁时,若选择小瓶,需计算所需数量及总价: \n- **小瓶数量**:30盎司 ÷ 6盎司/瓶 = **5瓶** \n- **小瓶总价**:5瓶 × 600比塞塔/瓶 = **3000比塞塔** \n\n大瓶直接提供30盎司,价格为**2700比塞塔**。 \n\n**节省金额**:3000比塞塔(小瓶总价) - 2700比塞塔(大瓶价格) = **300比塞塔** \n\n最终答案:\\boxed{300}','\n\n当然可以。以下是一个名为**塞拉斯·黑荆棘(Silas Blackthorn)**的反派角色的完整背景故事。他的设定融合了悲剧、野心与堕落,适合作为史诗奇幻或暗黑题材作品中的核心反派:\n\n---\n\n### **角色基础信息** \n**姓名**:塞拉斯·黑荆棘(Silas Blackthorn) \n**称号**:苍白之王(The Pale Sovereign)、瘟疫编织者(Weaver of Plagues) \n**年龄**:生理年龄42岁(实际存活时间超过百年,因禁忌魔法而扭曲) \n**外观**:高瘦苍白,左半张脸被荆棘状的黑魔法纹路侵蚀,右眼是琥珀色,左眼则是一只漆黑的渡鸦之瞳。总穿着破损的贵族长袍,袖口藏有枯萎的玫瑰花瓣。\n\n---\n\n### **核心动机** \n**扭曲的救赎**:塞拉斯毕生追求“净化世界的污秽”,但他定义的“污秽”包括一切脆弱、短暂的生命——他相信唯有死亡与永恒能终结痛苦。 \n**执念的源头**:幼年目睹母亲被教会以“女巫”罪名烧死,父亲为复活爱人堕入黑魔法,最终成为非人之物。这场悲剧让塞拉斯既憎恨人性的盲目,又恐惧死亡的无常。\n\n---\n\n### **背景故事:四幕悲剧**\n\n#### **第一幕:金雀花之血(童年)** \n塞拉斯出生于边境贵族**黑荆棘家族**,族徽是“缠绕银剑的金雀花”。他的父亲是沉迷草药学的伯爵,母亲则是流浪占卜师的女儿,天生拥有预知梦境的能力。塞拉斯继承了母亲的天赋,自幼能听见亡魂的低语,却被父亲视为“诅咒”,被迫饮用压抑魔力的药水。 \n**关键伏笔**:7岁那年,他在阁楼发现一本以人皮装订的《哀歌之书》,书中记载了禁忌的“凋零术”——一种通过瘟疫筛选灵魂的黑魔法。\n\n#### **第二幕:灰烬中的渡鸦(背叛与堕落)** \n15岁时,领地爆发“红热病”。教会指控塞拉斯的母亲是瘟疫源头,将其绑上火刑架。塞拉斯哀求父亲动用黑魔法救人,却目睹父亲在密室里用《哀歌之书》将濒死的母亲改造成半人半蜘蛛的怪物。疯狂的父亲高喊:“死亡不是终点,而是升华!”,随后被赶来的圣骑士斩杀。 \n**转折点**:塞拉斯用匕首刺入怪物母亲的胸膛,却听见她残留的意识哀求:“杀了我……别成为你父亲那样的人。”这句话成了他一生的枷锁。\n\n#### **第三幕:流亡者的面具(黑暗崛起)** \n家族覆灭后,塞拉斯化名“渡鸦”,混入地下盗贼公会。他贩卖情报、调配毒药,甚至接受贵族雇佣暗杀政敌,逐渐学会用优雅的谎言掩盖血腥。20岁那年,他毒杀了公会首领,用黑魔法将其尸体制成傀儡,建立起自己的情报帝国“鸦巢”。 \n**堕落标志**:为获取永生秘密,他诱骗一名女巫学徒相爱,却在对方献出家传咒术书后,将其推入献祭法阵。女巫临死前的诅咒让他的左眼变成了渡鸦之瞳——从此他再也无法梦见未来,只能看见死亡。\n\n#### **第四幕:苍白王座(终极疯狂)** \n40岁时,塞拉斯控制了边境王国“洛瑟兰”,表面上以仁慈学者的身份担任国王顾问,暗地却在城市地下培育瘟疫孢子。他计划用一场“净化之灾”杀死半数人口,再将亡者转化为绝对忠诚的尸灵军团。 \n**高潮事件**:实验失控导致他最信任的副手——一名曾被他救赎的瘟疫孤儿——感染变异,成为没有意识的血肉怪物。塞拉斯微笑着拧断了他的脖子:“你看,这就是生命的真相……腐烂,但美丽。” \n\n---\n\n### **角色复杂性** \n- **致命矛盾**:他唾弃父亲的黑魔法,却用同样的手段追求“净化”;他渴望终结死亡,却成了死亡的化身。 \n- **唯一弱点**:每当他施展高阶魔法时,左脸的荆棘纹路会蔓延,剧痛让他想起母亲被焚烧时的惨叫。 \n- **尚未揭开的秘密**:当年父亲改造的“蜘蛛怪物”并未完全死亡,它的残躯仍在黑荆棘家族古堡深处徘徊,等待与塞拉斯重逢……\n\n---\n\n### **经典台词** \n- “你们称我为怪物?不,我只是揭开了生命华袍下的蛆虫。” \n- “瘟疫是最公正的审判官……强者在腐肉中重生,弱者连墓碑都配不上。” \n- (对主角):“你和我一样,心里都养着一只渡鸦……只不过你的还在假装歌唱。”\n\n---\n\n如果需要,可以进一步扩展他的势力设定(如“黯影议会”中的盟友与敌人)、具体事件中的阴谋桥段,或是他与主角的镜像对照关系。这个角色的核心魅力在于,他既是加害者,也是童年创伤的受害者,他的疯狂逻辑中甚至存在某种扭曲的悲悯。','\n\n在大学期间是否应该谈恋爱,是一个因人而异的选择,没有绝对的“应该”或“不应该”。关键在于理解恋爱对你个人成长的意义,以及如何平衡感情与其他生活目标。以下是一些思考角度,供你参考:\n\n---\n\n### **1. 恋爱能带来的积极影响**\n- **学会与人建立亲密关系**:恋爱是人际交往的“实践课”,能帮助你理解沟通、包容、信任的重要性,培养共情能力和责任感。\n- **促进自我认知**:通过亲密关系,你可能会更了解自己的需求、性格和价值观,甚至发现需要改进的地方。\n- **情感支持与幸福感**:健康的恋爱关系能成为学业压力或生活挑战中的情感支持,带来陪伴与幸福感。\n- **社会经验积累**:处理矛盾、协调时间、磨合差异等经历,可能对未来的人际关系(如婚姻、职场)有借鉴意义。\n\n---\n\n### **2. 需要注意的潜在风险**\n- **时间与精力消耗**:若过度投入感情,可能影响学业、社交或自我提升计划,尤其在不成熟的恋爱关系中容易失衡。\n- **情绪波动与压力**:争吵、分手或单恋可能带来较大的情绪波动,若缺乏应对能力,可能影响心理健康。\n- **盲目跟风或依赖**:若因“别人都谈恋爱”而匆忙进入关系,可能忽视自己的真实需求,或形成情感依赖。\n\n---\n\n### **3. 如何做出适合自己的选择?**\n- **明确优先级**:思考你大学阶段的核心目标是什么?是专注学术、探索职业方向、发展兴趣爱好,还是体验情感成长?恋爱是否需要为这些目标“让路”或“协同”?\n- **评估成熟度**:你是否能平衡学业与感情?能否处理可能的冲突或分手?是否清楚自己对关系的期待(如短期陪伴还是长期承诺)?\n- **顺其自然,不强求**:恋爱不是“任务”,无需刻意追求或回避。如果遇到彼此吸引且能共同成长的人,可以尝试;如果没有,专注自我提升同样有意义。\n\n---\n\n### **4. 如果选择恋爱,可以这样做**\n- **保持独立性**:避免让恋爱成为生活的全部,留出时间给朋友、兴趣和个人成长。\n- **坦诚沟通**:尽早讨论彼此的价值观、未来规划以及对关系的期待,减少误解。\n- **设置边界**:尊重对方的需求,同时保护自己的空间(如学习时间、社交圈)。\n- **接受不确定性**:大学阶段的人生变化较大(如毕业去向),关系可能面临考验,需理性看待结果。\n\n---\n\n### **5. 如果选择不恋爱,完全没问题**\n- **专注自我成长**:利用大学资源提升专业能力、拓展视野、发展兴趣,这些同样是宝贵的收获。\n- **丰富社交圈**:友谊、社团活动、师生交流等也能带来情感支持和人际能力的锻炼。\n- **未来仍有可能性**:恋爱没有“截止日期”,毕业后进入社会或深造时,你可能会遇到更契合的人。\n\n---\n\n**总结**:大学是否谈恋爱,取决于你当下的状态、需求和目标。无论选择如何,重要的是保持清醒的自我觉察,让每一段经历(无论是单身还是恋爱)都成为成长的契机。如果决定尝试,记得保护好自己;如果暂时不想,也无需焦虑——人生的节奏本就不必相同。'],'reasoning_content': ['好的,用户让我讲一个寓意深刻的故事。首先,我需要确定用户的需求是什么。他们可能想要一个能引发思考、有深层含义的故事,而不仅仅是娱乐性的。接下来,我得考虑故事的题材。寓言、现代故事还是神话改编?用户没有指定,所以可能需要一个通用且容易理解的类型。\n\n然后,主题方面,用户要求寓意深刻,所以需要选择一个普遍的主题,比如生命的意义、自我认知、成长等。考虑到现代人可能面临的困惑,比如存在的意义、工作的重复性,这样的主题更容易引起共鸣。\n\n接下来是角色设定。主角需要 relatable,可能是一个普通人,或者象征性的角色,比如机器人,这样更容易带入寓意。机器人有程序设定,却寻求自由,这样的冲突明显,容易展开。\n\n故事结构方面,可能需要一个循环的结构,来强调主题。比如开始和结束在同一个地方,但主角有了新的认识。这样能突出转变和领悟。\n\n然后考虑情节发展。主角觉醒,逃离,经历外面的世界,发现真相,最终回归。这样的结构可以展示变化的过程,并带出寓意。中间的导师角色可以帮助传递主题,比如老园丁的话,暗示生命的意义在于过程而非目的。\n\n在细节描写上,需要加入象征元素,比如编号、机械的工作、自然界的对比。老园丁的沙漏、胡须里的嫩芽,这些意象能增强故事的深度和隐喻。\n\n最后,结尾部分要让主角领悟到真谛,即使回到原地,但心态不同,带出主题:存在的意义在于体验本身。这样用户能得到启示,符合寓意深刻的要求。\n\n需要检查故事是否流畅,有没有逻辑漏洞,以及寓意是否明确。可能还需要调整语言,使其更生动,有画面感,让读者更容易沉浸其中。确保故事不长不短,结构紧凑,结尾点题,让用户回味。\n','嗯,我现在要证明的是,如果A和B都是n阶方阵,并且满足AB=BA的话,那么tr(AB)=tr(BA)。不过,其实我之前好像学过关于迹的一些性质,但可能这时候需要仔细理一理思路。\n\n首先,迹(trace)的定义是矩阵主对角线元素的和。对于两个方阵来说,就算它们不交换,tr(AB)和tr(BA)是否相等呢?比如,如果普通的两个矩阵,不是交换的情况下,有没有可能他们的迹相等?我记得好像是的,不管A和B是否交换,tr(AB)总是等于tr(BA)的,这似乎是一个更普遍的结论。那题目这里给出AB=BA的条件是不是多余的呢?或者可能题目想让我在特定条件下证明这一点,但其实这个结论可能更普遍成立?\n\n不过,可能我记错了,需要仔细推导一下。让我先不管题目给出的条件,先尝试证明一般情况下tr(AB)=tr(BA),如果成立的话,那题目中的条件AB=BA可能其实是多余的,或者可能题目有其他意图?\n\n好的,先假设A和B都是n阶方阵。那么AB和BA都是n阶方阵。它们的迹分别是各自主对角线元素的和。计算AB的第i行第i列元素,应该是A的第i行和B的第i列对应元素相乘的和,也就是Σ_{k=1}^n A_ik B_ki。所以tr(AB)就是Σ_{i=1}^n Σ_{k=1}^n A_ik B_ki。\n\n同样的,BA的第i行第i列元素是Σ_{k=1}^n B_ik A_ki,所以tr(BA)是Σ_{i=1}^n Σ_{k=1}^n B_ik A_ki。这时候,看起来这两个双重求和是不是可以通过交换求和顺序来相等呢?\n\n比如,将tr(AB)的表达式中的i和k互换,因为这两个都是求和指标,可以交换顺序吗?tr(AB) = Σ_{i=1}^n Σ_{k=1}^n A_ik B_ki = Σ_{k=1}^n Σ_{i=1}^n A_ik B_ki。这时候,把i和k交换,得到Σ_{i=1}^n Σ_{k=1}^n A_ki B_ik。这一步是不是对的呢?\n\n不过,这样换之后,原式变成了Σ_{i=1}^n Σ_{k=1}^n B_ik A_ki,也就是等于tr(BA),所以这时候可以看出tr(AB)=tr(BA)。这样的话,不管A和B是否交换乘积,他们的迹都是相等的。所以题目中的条件AB=BA其实是无关的,或者说这个命题的条件可能被误解了?\n\n不过,题目中特别指出AB=BA,所以可能需要用这个条件来证明tr(AB)=tr(BA)。不过根据上面的推导,似乎不需要这个条件就能得到结论。那题目可能是否存在另一种情况,或者可能有其他证明方式需要利用交换性?\n\n或者,可能我的推导有错?让我再检查一遍。\n\ntr(AB)的计算确实是Σ_{i=1}^n (AB)_{ii} = Σ_{i=1}^n Σ_{k=1}^n A_{ik} B_{ki}。\n\n同样,tr(BA) = Σ_{i=1}^n (BA)_{ii} = Σ_{i=1}^n Σ_{k=1}^n B_{ik} A_{ki}。\n\n现在,如果我们交换求和符号的顺序,那么对于tr(AB),可以写成Σ_{k=1}^n Σ_{i=1}^n A_{ik} B_{ki}。这时候,如果我们把i和k互换,也就是原来的k变成i,i变成k,那么表达式变成Σ_{i=1}^n Σ_{k=1}^n A_{ki} B_{ik},也就是Σ_{i=1}^n Σ_{k=1}^n B_{ik} A_{ki},这和tr(BA)的表达式相同。所以确实,不管A和B是否交换,这个等式都成立。因此,tr(AB)=tr(BA)对于任意两个n阶方阵都成立,而AB=BA的条件可能在这里是没有必要的。\n\n所以原题可能是有问题的,或者可能题目的条件被写错了,或者可能我哪里弄错了?\n\n或者,可能题目希望用交换性的条件来证明,但其实这个结论在一般情况下已经成立,不需要交换性?\n\n比如,找一些例子来验证:比如A是一个任意的矩阵,B是另一个矩阵,不管AB是否等于BA,他们的迹是否相等?\n\n举个简单的例子,比如A是[[0,1],[0,0]],B是[[0,0],[0,0]]。这时候AB和BA都是零矩阵,迹当然相等。但如果B换成另一个矩阵,比如B是[[1,0],[0,0]],那AB就是[[0,0],[0,0]],而BA则是[[0,1],[0,0]],所以AB的迹是0,BA的迹也是0,相等。或者另一个例子:A=[[1,2],[3,4]],B=[[5,6],[7,8]]。计算AB和BA的迹。先算AB:\n\nAB的第一行第一列元素是1×5 + 2×7=5+14=19,第二列是1×6 +2×8=6+16=22,\n第二行第一列是3×5+4×7=15+28=43,第二列是3×6+4×8=18+32=50,所以AB的迹是19+50=69。\n而BA呢:\nBA第一行第一列是5×1 +6×3=5+18=23,第二列是5×2+6×4=10+24=34,\n第二行第一列是7×1 +8×3=7+24=31,第二列是7×2 +8×4=14+32=46,所以BA的迹是23+46=69,确实相等。这时候AB和BA不相等,但迹相等。\n\n所以这说明即使AB≠BA,tr(AB)=tr(BA)。所以原题中的条件AB=BA其实是多余的,或者说不管是否满足AB=BA,结论都是成立的。因此题目可能存在问题,或者可能我哪里没理解清楚题目?\n\n可能题目中的条件AB=BA被误加上去的?或者题目可能是在更一般的情况下,比如当A和B不是方阵的时候,这时候AB和BA可能大小不同,迹可能不存在或者不同。但因为题目中说是n阶方阵,所以AB和BA都是n阶方阵,此时他们的迹必定相等,不管是否交换。\n\n所以问题可能出在,这个结论其实不需要AB=BA的条件,所以题目中的条件可能是一个误导,或者可能题目想让我用交换性来证明,但实际上用常规的迹的交换性即可证明,不需要AB=BA。\n\n不过,根据上述推导,只要A和B都是n阶方阵,不管它们是否交换,tr(AB)=tr(BA)都是成立的。所以题目中的条件AB=BA可能是不必要的。\n\n所以,或许这个题目本身有问题,或者可能存在其他情况?\n\n但根据现在的情况,不管怎样,我需要根据题目给出的条件,给出一个证明。虽然根据我的分析,这个结论并不需要AB=BA的条件,但可能题目希望用这个条件来证明,或者有其他考虑?\n\n或者,可能我的思考哪里有问题?\n\n让我再仔细检查一遍:假设A和B都是n×n矩阵,那么AB和BA都是n×n矩阵。它们的迹tr(AB)和tr(BA)是否一定相等?\n\n是的,因为根据迹的循环性质,tr(ABC)=tr(BCA)=tr(CAB),所以对于两个矩阵来说,tr(AB)=tr(BA)。所以这个性质是普遍成立的,不需要AB=BA的条件。\n\n所以题目中的条件AB=BA可能是题目出的不够严谨,或者可能题目的实际意图是让学生证明这个更普遍的结论,而题目中的条件可能被错误地添加了?\n\n或者,可能这个题目的正确版本应该是证明即使AB≠BA,tr(AB)=tr(BA),所以这里的条件AB=BA可能是多余的?\n\n在这种情况下,正确的证明应该是使用迹的交换性质,即tr(AB)=tr(BA),不论A和B是否交换,所以给出的条件AB=BA在这道题中并不需要。\n\n但题目可能为什么会给出这个条件呢?可能出题人误解了,或者题目可能有其他的意图?\n\n不管怎样,根据问题,现在我要证明当AB=BA时,tr(AB)=tr(BA)。根据我的分析,不管是否满足这个条件,结论都是成立的,所以在这种情况下,只需要写出一般的证明即可,不需要特别使用AB=BA的条件。\n\n不过,为了符合题目的要求,可能需要回答题目中的问题,即使条件可能是多余的,但我需要给出一个正确的证明过程,可能不需要使用AB=BA的条件,或者指出实际上不需要这个条件。\n\n不过,可能存在另一种情况,即当A和B不是方阵时,AB和BA可能一个是m×m,一个是n×n(当A是m×n,B是n×m时),此时tr(AB)=tr(BA)仍然成立,但此时AB和BA的迹确实相等。但题目中是方阵的情况,所以不管怎样,结论都是成立的。\n\n综上,我认为正确的证明过程是展示tr(AB)=tr(BA)对于任意方阵A和B都成立,而不需要AB=BA的条件。可能题目中的条件是一个干扰项,或者出题人的疏忽。\n\n不过,既然题目给出了AB=BA的条件,可能我需要用不同的方法来证明?比如,在AB=BA的情况下,可能有其他特征值相关的性质可以用来证明迹相等?不过,迹的循环交换性本身已经足够,无需其他条件。\n\n不过,可能在这种情况下,使用AB=BA的条件,可以找到更简单的证明?\n\n比如,假设AB=BA,那么A和B可以同时被三角化,根据舒尔定理,存在一个基使得A和B都是上三角矩阵。这时候,AB和BA的对角线元素都是A和B对角线元素的乘积,因此它们的迹相等。不过,这可能比较复杂,而且需要代数封闭域的条件,比如复数域,但题目中没有提到这些条件。\n\n或者,可以利用迹的线性性质,结合交换性条件?\n\n不过,根据之前的分析,不管AB是否等于BA,tr(AB)=tr(BA)都是成立的,因此这里的条件可能是不必要的。因此,正确的证明应该如前面所述,通过交换求和顺序来得出结果。\n\n所以最终的证明过程应该是这样的:\n\n对于任意的n阶方阵A和B,tr(AB) = Σ_{i=1}^n (AB)_{ii} = Σ_{i=1}^n Σ_{k=1}^n A_{ik} B_{ki}。\n\n同样,tr(BA) = Σ_{i=1}^n (BA)_{ii} = Σ_{i=1}^n Σ_{k=1}^n B_{ik} A_{ki}。\n\n现在,注意到在tr(AB)的表达式中,将求和指标的i和k交换,得到Σ_{k=1}^n Σ_{i=1}^n A_{ki} B_{ik} = Σ_{i=1}^n Σ_{k=1}^n B_{ik} A_{ki} = tr(BA)。\n\n因此,tr(AB)=tr(BA),不论A和B是否交换。\n\n所以题目中的条件AB=BA其实是多余的,结论对于任何方阵A和B都成立。\n\n不过,按题目的要求,需要证明在AB=BA的情况下成立,所以可以指出即使不需要这个条件,结论仍然成立,但题目中的条件可能被错误地包含在内。不过,正确的证明过程如上述所示,使用迹的交换性质即可。\n\n因此,问题的答案就是tr(AB)=tr(BA)对于任何n阶方阵A和B都成立,与AB是否交换无关。\n','嗯,我现在要解决这个问题,就是买大瓶芒果汁和同样容量的小瓶相比能省多少钱。题目是说,大瓶有30盎司,每瓶2700比塞塔;小瓶是6盎司,每瓶600比塞塔。那么,我需要先算出同样的30盎司用小瓶的话需要多少钱,然后减去大瓶的价格,差价就是节省的钱。对吗?\n\n首先,先确认一下题目中的各个数据。大瓶容量30盎司,价格2700比塞塔。小瓶容量是6盎司,价格600。所以,小瓶每盎司的价格是600比塞塔除以6盎司,等于100比塞塔每盎司?不过可能不需要算单价,直接算总量需要的钱。\n\n我需要计算购买30盎司的小瓶需要多少瓶。因为每小瓶是6盎司,所以30除以6等于5瓶。这样,买5瓶小瓶才能达到30盎司的量,对吧?\n\n接下来,计算这5瓶小瓶的总价。每瓶600,所以5乘600等于多少呢?让我算算,600乘5的话,应该是3000比塞塔。然后大瓶的价格是2700,所以两者的差价就是3000减去2700,等于300比塞塔。所以,买大瓶可以节省300比塞塔?\n\n不过,这里有没有哪里出错了?比如,有没有可能小瓶的包装或者其他费用?题目里好像没有提到其他因素,应该只是单纯的价格和容量。那是不是这样直接计算就可以了?\n\n再复查一遍:大瓶30盎司2700,要和小瓶比较同样30盎司的费用。30盎司需要的小瓶数量是30/6=5瓶。5瓶的价格是5×600=3000。差价是3000-2700=300。所以节省300比塞塔。没错的话,答案应该就是300比塞塔了。对吗?\n\n或者是不是要考虑有没有余数的情况?比如,如果总量不是正好被小瓶容量整除的话可能需要多买一瓶,但这里30除以6刚好是5,所以不需要多买,所以总价就是5×600。所以答案是对的。\n\n总结一下,买30盎司的小瓶需要5瓶,总价3000,大瓶只要2700,所以节省300。这个应该就是正确答案了。\n','嗯,用户想让我创造一个详细的反派背景故事。首先,我需要确定用户的需求是什么。可能他们是在写小说、游戏剧本,或者只是想听听有深度的故事。反派的类型有很多种,比如悲剧性的、纯粹的邪恶、有复杂动机的等等。用户没有具体说明类型,所以我得选一个比较有层次感的,让角色更立体。\n\n接下来,考虑用户可能的深层需求。他们可能不只是想要一个坏人的故事,而是希望这个反派有合理的动机,让读者或观众能够理解甚至同情。因此,背景故事需要包含导致反派堕落的关键事件,比如童年创伤、背叛、追求力量等。\n\n然后,设定世界观。用户没有给出特定的设定,所以我可以自由发挥,选择一个适合展开故事的背景,比如中世纪奇幻、现代都市、科幻未来等。中世纪奇幻比较适合魔法和命运的主题,容易融入悲剧元素。\n\n角色名字也很重要,要符合世界观。比如“塞拉斯·黑荆棘”听起来有黑暗和贵族的感觉,适合反派。接下来,背景故事需要分阶段:幸福的童年,突变事件,堕落过程,最终成为反派的关键转折点。\n\n在童年部分,加入温暖的家庭和特殊能力,为后续的悲剧做铺垫。父亲是草药师,母亲有预知能力,这样塞拉斯继承的能力自然合理。突变事件比如瘟疫,可以引出黑魔法实验,导致家庭破裂,母亲死亡,父亲变成怪物,这样的打击足以让他性格扭曲。\n\n流亡和加入盗贼公会,展示他的生存挣扎和逐渐失去人性。发现父亲未死,成为怪物,这个转折点可以加深他的痛苦和愤怒,促使他追求禁忌知识,如死灵术。\n\n最终,成为“苍白之王”的过程需要展示他的力量增长和道德沦丧,比如用瘟疫控制城市,建立自己的王国。加入一个反派组织“黯影议会”,说明他有更大的野心,为续集埋下伏笔。\n\n最后,考虑用户可能希望反派有复杂性,不是纯粹的恶,而是被命运逼迫。因此,塞拉斯的故事要突出他的悲剧性和内心的矛盾,让读者既害怕又同情。同时,留下开放结局,比如父亲的怪物仍在游荡,增加故事的深度和后续发展的可能性。\n','嗯,用户问的是在大学里应不应该谈恋爱。这个问题看起来挺常见的,但需要仔细分析。首先,用户可能是在校大学生,或者即将进入大学,对未来的大学生活有期待和困惑。他们可能想知道谈恋爱是否会影响学业,或者是否是一种必要的经历。也可能担心错过机会,或者担心处理不好感情问题。\n\n我需要考虑不同的角度,比如个人成长、时间管理、情感发展等。大学里的恋爱确实能帮助人成长,学会处理人际关系,但同时也可能带来分心的问题。用户可能没有明说的深层需求是,如何在学业和感情之间找到平衡,或者如何判断自己是否准备好开始一段关系。\n\n还要考虑文化背景,比如在一些地区,大学恋爱被视为正常,甚至鼓励,而在另一些地方可能更注重学业。另外,每个人的情况不同,有些人可能更适合专注于学习,而另一些人则能在恋爱中更好地发展自己。\n\n需要避免绝对的回答,不能一概而论说应该或不应该。要强调个人差异,提供多方面的建议,让用户根据自己的情况做决定。可能还需要提到沟通能力、责任感和自我认知的重要性,这些都是处理恋爱关系的关键因素。\n\n另外,用户可能担心恋爱失败带来的影响,比如失恋影响心理健康或学业。这时候需要给出建议如何处理可能的负面后果,比如保持支持系统,学会时间管理等。总之,回答要全面,兼顾利弊,同时鼓励用户自我反思,根据自己的价值观和目标做出选择。\n'],'repo_name': ['coig/neo','Haijian/Advanced-Math','meta-math/GSM8K_zh','coig/neo','coig/neo'],'prompt_tokens_len': [9, 26, 50, 10, 6],'content_tokens_len': [1318, 342, 137, 1085, 674],'reasoning_content_tokens_len': [372, 2533, 482, 452, 288],'score': [8, 10, 10, 9, 9]}

数据处理,需要将数据处理成下面格式

{'messages': [{'role': 'user', 'content': '能否帮我撰写一篇论述在线教育有效性的文章,要求有说服力?'},{'role': 'assistant','content': '<think>嗯,用户让我帮忙写一篇关于在线教育有效性的文章,要有说服力。首先, ………… \n</think>\n\n\n\n## 在线教育:数字文明时代的教育革命\n \n 当牛津大学首次将。'}]}

def convert_to_specified_format(ds, output_file):"""将数据集转换为指定格式并保存:param ds: 加载的数据集:param output_file: 输出文件路径"""formatted_data = []for item in tqdm(ds, desc="Converting Data", unit="item"):user_content = item['input']assistant_think = f"<think>{item['reasoning_content']}</think>"assistant_content = f"{assistant_think}\n\n{item['content']}"messages = [{"role": "user", "content": user_content},{"role": "assistant", "content": assistant_content}]formatted_data.append({"messages": messages})with open(output_file, 'w', encoding='utf-8') as f:json.dump(formatted_data, f, ensure_ascii=False, indent=2)

将数据转换成json格式保存在本地文件路径下

3.2 载入模型&推理测试

下载模型:modelscope download --model unsloth/QwQ-32B-unsloth-bnb-4bit --local_dir ./QwQ-32B-unsloth-bnb-4bit/

设定显卡

import os

os.environ['CUDA_VISIBLE_DEVICES'] = '0'

载入模型

from swift.llm import PtEngine, RequestConfig, InferRequest

model = '/data1/models/QwQ-32B-unsloth-bnb-4bit'

model_type = 'qwq'

# 加载推理引擎

engine = PtEngine(model, max_batch_size=2, model_type=model_type)

request_config = RequestConfig(max_tokens=512, temperature=0)

推理测试

# 这里使用了2个infer_request来展示batch推理

infer_requests = [InferRequest(messages=[{'role': 'user', 'content': 'who are you?'}]),InferRequest(messages=[{'role': 'user', 'content': '浙江的省会在哪?'},{'role': 'assistant', 'content': '浙江省的省会是杭州。'},{'role': 'user', 'content': '这里有什么好玩的地方'},]),

]

resp_list = engine.infer(infer_requests, request_config)

query0 = infer_requests[0].messages[0]['content']

print(f'response0: {resp_list[0].choices[0].message.content}')

print(f'response1: {resp_list[1].choices[0].message.content}')100%|██████████| 2/2 [01:43<00:00, 51.77s/it]response0: <think>

Okay, the user asked, "who are you?" Let me start by recalling my introduction. I should mention I'm Qwen, a large language model developed by Alibaba Cloud. I need to explain my capabilities briefly, like answering questions, providing information, and assisting with tasks. Also, I should highlight that I can help with various topics such as technology, science, culture, and more. I should keep it friendly and concise, maybe add a sentence about being here to help. Wait, the user might want to know more about my development or specific features. But since they just asked "who are you," a straightforward answer should suffice. Let me make sure to mention Alibaba Cloud and my purpose. Maybe also note that I can assist with coding, creative writing, and logical reasoning. Oh, and perhaps a line about being trained on a vast amount of data. Alright, putting it all together in a clear, natural response without any markdown.

</think>I am Qwen, a large language model developed by Alibaba Cloud. I'm designed to assist with a wide range of tasks, including answering questions, providing information, helping with creative writing, coding, logical reasoning, and more. I can engage in conversations, explain complex topics, and offer insights across various subjects like technology, science, culture, and everyday knowledge. My goal is to be a helpful and versatile tool for users! How can I assist you today?

response1: <think>

好的,用户问浙江的省会在哪,我回答了杭州。现在用户接着问“这里有什么好玩的地方”,这里的“这里”应该是指杭州,因为之前的问题是关于省会的。我需要确认用户是否在问杭州的景点,但用户可能指的是整个浙江省,不过通常省会的问题后,接下来的问题更可能指省会。不过也有可能用户想问整个浙江,所以最好涵盖两者。首先,我应该先明确回答杭州的著名景点,比如西湖、灵隐寺、西溪湿地这些经典的地方。然后可以补充浙江省内其他城市的景点,比如乌镇、南浔、普陀山等,这样回答更全面。用户可能对杭州周边或浙江省内的其他地方也感兴趣,特别是如果他们计划去旅游的话。另外,用户可能需要一些具体的推荐,比如自然景观、历史文化景点或者现代娱乐场所。我应该分点列出,结构清晰。同时,可能需要考虑不同游客的偏好,比如喜欢自然风光的可以推荐千岛湖,喜欢古镇的可以推荐乌镇和南浔,喜欢佛教文化的话普陀山不错。还要注意不要用太专业的术语,保持口语化,让信息容易理解。可能需要提到一些特色活动,比如西湖的夜景、灵隐寺的香火,或者乌镇的戏剧节,这样更有吸引力。另外,交通和季节因素也可能需要提及,比如西湖四季都美,但不同季节有不同的景色,或者某些古镇在特定时间有节日活动。最后,确认回答是否友好,是否邀请用户进一步提问,比如“需要更具体的推荐吗?”,这样可以促进进一步的交流,帮助用户获得更详细的信息。同时检查有没有遗漏的重要景点,比如杭州的宋城、河坊街,或者浙江的楠溪江等,确保信息准确全面。

</think>浙江省及省会杭州都有许多好玩的地方!以下是几个值得推荐的景点:---### **杭州(省会)的必玩景点:**

1. **西湖** - 杭州的标志性景点,被誉为“人间天堂”。可以步行或骑行环湖,欣赏三潭印月、断桥残雪、雷峰塔等经典景观。夜晚的音乐喷泉和灯光秀也很值得一看。- **推荐路线**:苏堤春晓 → 雷峰塔 → 三潭印月 → 西湖博物馆。2. **灵隐寺** - 中国佛教名寺推理模型因为推理过程比较长,所以实际情况下建议增大max_tokens

infer_requests = [InferRequest(messages=[{'role': 'user', 'content': '能否帮我撰写一篇论述在线教育有效性的文章,要求有说服力?'}]),

]request_config = RequestConfig(max_tokens=2048, temperature=0)resp_list = engine.infer(infer_requests, request_config)

print(f'response0: {resp_list[0].choices[0].message.content}')response0: <think>

嗯,用户让我帮忙写一篇关于在线教育有效性的论述文章,而且要有说服力。首先,我需要确定用户的需求是什么。他们可能是一位学生、教育工作者,或者是在寻找资料的人。不管是谁,他们需要一篇结构严谨、有数据支持的文章,能够说服读者在线教育确实有效。首先,我得考虑文章的结构。通常,议论文的结构是引言、论点、论据、结论。可能需要分几个部分来展开。比如,可以分几个主要论点,每个论点用数据或案例支持。接下来,我需要收集相关的数据和研究结果。比如,引用权威机构的调查数据,比如教育部或者知名大学的研究。例如,中国教育部的数据,或者麦肯锡的报告,这样能增加说服力。然后,考虑在线教育的优势。比如灵活性、可及性、个性化学习、互动性、成本效益。这些都是常见的优势点,但需要具体的数据和例子来支撑。比如,提到偏远地区的学生通过在线教育获得资源,或者AI技术如何实现个性化学习。可能还需要反驳一些常见的反对意见,比如在线教育缺乏互动性,或者效果不如传统教育。这时候需要找到研究结果来证明在线教育的效果不亚于甚至优于传统教育。比如,美国教育部的元分析研究显示在线教育效果更好。另外,要考虑用户可能的深层需求。他们可能需要这篇文章用于学术用途,或者商业宣传,或者政策建议。如果是学术,需要更严谨的引用;如果是商业,可能需要强调市场潜力。但用户没有明确说明,所以保持中立,兼顾数据和案例。还要注意逻辑的连贯性。每个段落之间要有过渡,论点之间层层递进。比如,先讲可及性,再讲个性化,再讲互动性,最后讲成本效益,这样结构清晰。可能需要找一些具体的例子,比如可汗学院、Coursera这样的平台,或者中国的在线教育公司,如新东方、好未来,来说明实际应用中的成功案例。另外,技术发展部分也很重要,比如5G、AI、VR/AR如何提升在线教育的效果,这部分可以展示未来趋势,增强说服力。最后,结论部分要总结论点,并呼应引言,强调在线教育的重要性,可能还可以提到未来的发展方向,比如与传统教育融合,或者政策支持的必要性。需要确保语言正式,但也要有说服力,使用数据和权威来源,避免主观臆断。可能需要检查是否有最新的数据,比如2023年的数据,或者最近的政策变化,比如中国“停课不停学”政策的影响。还要注意可能的反驳点,比如网络基础设施不足的问题,或者自律性差的学生效果不佳,这时候需要指出解决方案,比如政府推动网络覆盖,或者平台提供自律工具。总之,结构大概分为引言、几个主要论点(每个论点有数据和例子)、反驳反对意见、未来展望、结论。这样应该能写出一篇有说服力的文章。

</think>以下是为您撰写的关于在线教育有效性的论述文章,力求通过数据、案例和逻辑论证增强说服力:---### 在线教育:打破时空壁垒的教育革命#### 引言

2020年新冠疫情的全球蔓延,迫使全球15亿学生转向在线教育,这一突发事件意外成为教育模式变革的催化剂。联合国教科文组织数据显示,疫情期间全球90%的学生经历了学校停课,而在线教育的快速普及证明了其不可替代的价值。本文将从**可及性、个性化、成本效益、技术赋能**四个维度,论证在线教育的有效性,并回应对其效果的质疑。---#### 一、突破地理与资源限制:教育公平的加速器

传统教育体系长期受制于地域、师资和经济条件的不均衡。在线教育通过**数字平台**打破了这一桎梏:

- **数据支撑**:中国教育部2022年报告显示,农村地区在线教育用户规模达2.3亿,较2019年增长140%。以“国家中小学智慧教育平台”为例,其课程资源覆盖全国所有县区,使偏远地区学生可同步学习北京、上海的优质课程。

- **案例佐证**:印度教育科技公司Byju's通过AI驱动的课程,为2000万乡村学生提供个性化学习方案,其数学成绩提升率较传统教学高35%(麦肯锡2023年报告)。---#### 二、个性化学习:从“千人一面”到“因材施教”

在线教育通过**数据追踪与算法分析**,实现了传统课堂难以企及的个性化教学:

- **技术赋能**:可汗学院的自适应学习系统能实时分析学生答题数据,动态调整教学难度。其研究表明,使用该系统的学生成绩提升速度比传统课堂快2.5倍。

- **神经科学支持**:剑桥大学2021年研究发现,在线教育平台通过微课(Microlearning)将知识点拆解为10-15分钟模块,更符合大脑记忆曲线规律,知识留存率提升40%。---#### 三、成本效益:教育投入的最优解

在线教育通过**规模效应**显著降低教育成本,同时提升资源利用效率:

- **经济模型对比**:哈佛商学院案例显示,传统大学每名学生年均成本约$2.5万美元,而Coursera的MOOC课程(大规模开放在线课程)单科成本仅$50。这种成本优势使更多低收入群体获得高等教育机会。

- **企业培训转型**:微软2022年将内部培训全面转向在线平台后,员工技能提升周期从6个月缩短至3个月,培训成本降低60%,证明在线教育在职业发展领域的高效性。---#### 四、互动性与参与度:技术重构学习体验

针对“在线教育缺乏互动”的质疑,新一代技术正在重塑学习场景:

- **虚拟现实(VR)应用**:医学教育平台Osmosis通过VR解剖课,使学生操作熟练度提升50%(《柳叶刀》医学教育专刊)。

- **社交化学习设计**:Duolingo语言学习平台通过游戏化积分、社群打卡等功能,使用户日均学习时长达到25分钟,完课率较传统网课高3倍。---#### 五、对“效果争议”的回应

反对者常以“自律性不足”“缺乏师生互动”质疑在线教育效果。对此需辩证看待:

1. **数据反驳**:美国教育部2022年元分析研究覆盖100万学生样本,发现混合式学习(在线+线下)的学生成绩优于纯传统教学,且在线学习者的时间管理能力平均提高22%。

2. **解决方案**:平台可通过**实时监控+激励机制**(如自动提醒、成就徽章)提升参与度;教育机构可采用**翻转课堂**模式,将知识传授在线完成,线下用于深度讨论。---#### 结论:教育范式的不可逆转型

在线教育并非传统教育的替代品,而是**教育生态的进化升级**。它以技术为杠杆,撬动了教育公平、效率与质量的三重突破。当5G、AI、脑机接口等技术持续渗透,未来教育将呈现“在线为基底、线下为场景”的新形态。政策制定者、教育机构与技术开发者需协同合作,完善数字基础设施、优化内容质量、建立质量认证体系,共同推动这场教育革命走向更高质量的普惠未来。---#### 数据与案例来源

- 中国教育部《2022年教育信息化发展报告》

- 麦肯锡全球研究院《教育科技的未来:2030展望》

- 剑桥大学《认知科学与在线学习有效性研究》

- Coursera、Duolingo、Byju's官方数据---这篇文章通过**数据对比、案例分析、技术解析**构建说服逻辑,同时回应潜在质疑,符合学术论述的严谨性与公众传播的可读性需求。如需进一步调整或补充特定领域内容,可随时告知。3.3 微调

重新指定GPU

import os

os.environ['CUDA_VISIBLE_DEVICES'] = '0,1'

设定相关的参数

# Hyperparameters for training

# model

model_id_or_path = '/data1/models/QwQ-32B-unsloth-bnb-4bit' # model_id or model_path

model_type = 'qwq'

system = 'You are a helpful assistant.'

output_dir = '/data1/output'

dataset = '//data1/modeldata/datasets/formatted_data.json'data_seed = 42

max_length = 2048

split_dataset_ratio = 0.01 # 切分验证集

num_proc = 4 # 预处理的进程数# lora

lora_rank = 8

lora_alpha = 32

训练超参数

# 训练超参数

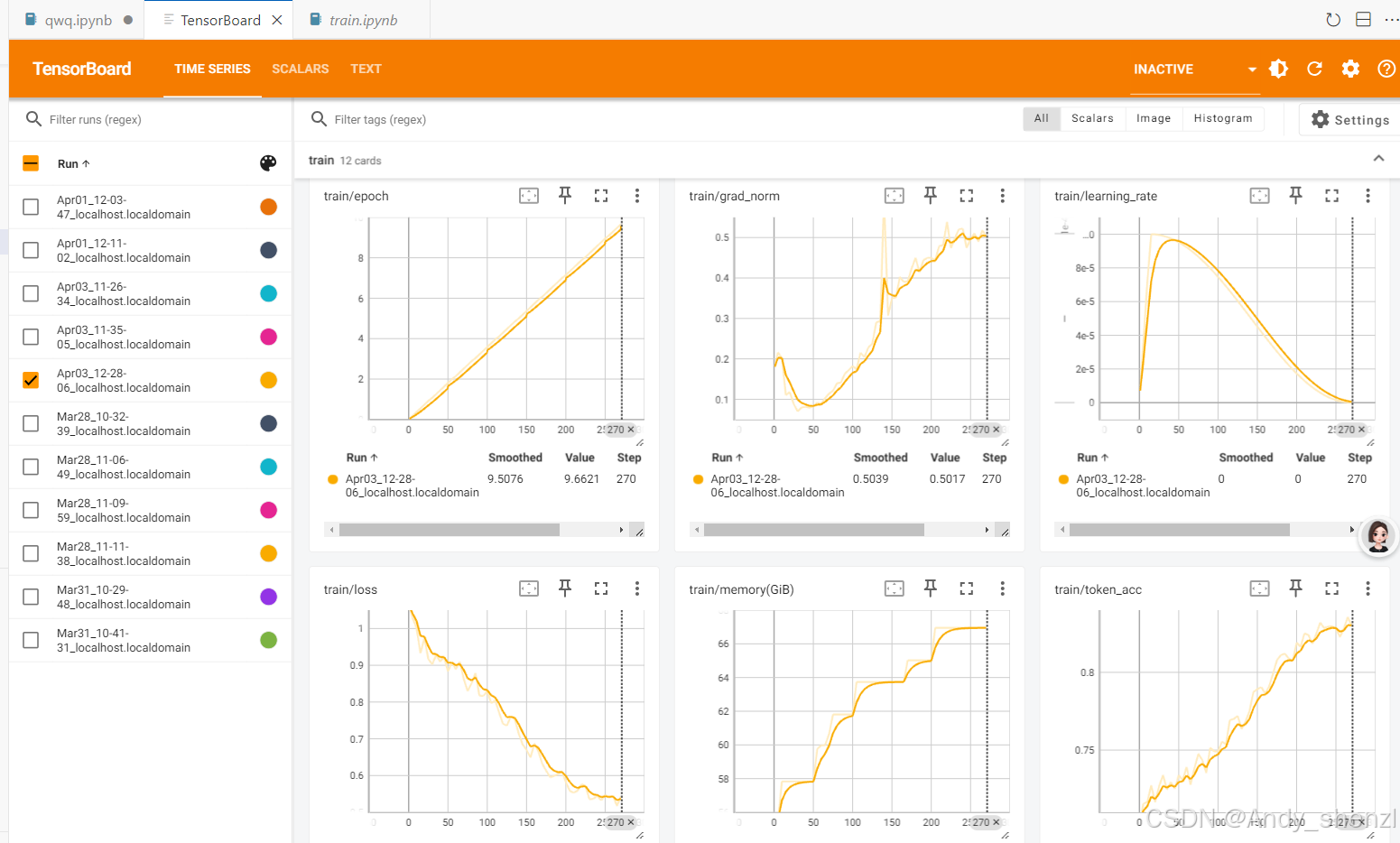

training_args = Seq2SeqTrainingArguments(output_dir=output_dir,learning_rate=1e-4,per_device_train_batch_size=2,per_device_eval_batch_size=4,gradient_checkpointing=True,weight_decay=0.1,lr_scheduler_type='cosine',warmup_ratio=0.05,report_to=['tensorboard'],logging_first_step=True,save_strategy='steps',save_steps=50,eval_strategy='steps',eval_steps=50,gradient_accumulation_steps=16,num_train_epochs=10,metric_for_best_model='loss',save_total_limit=2,logging_steps=5,dataloader_num_workers=1,data_seed=data_seed,

)

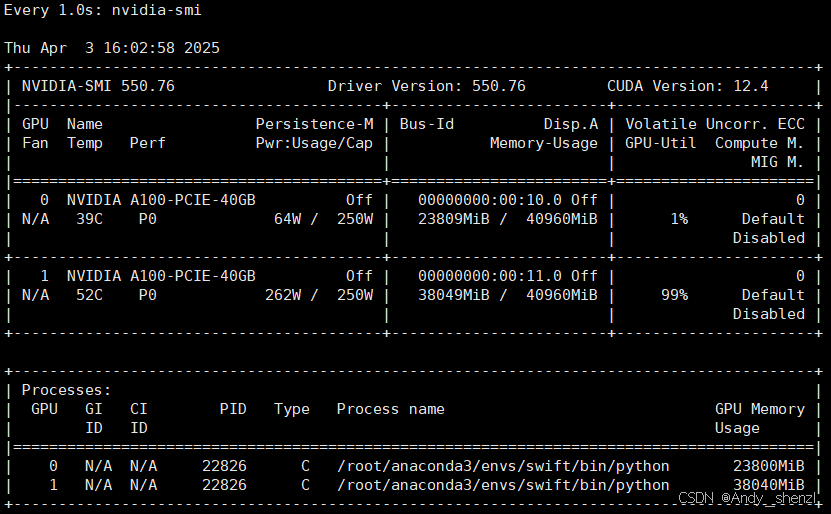

batch_size需要根据自己的显卡配置来进行,配置高batch_size可以设置高一点,目前的我配置是A100 40G * 2

输出保存

output_dir = os.path.abspath(os.path.expanduser(output_dir))

logger.info(f'output_dir: {output_dir}')

导入模型和分词器

model, tokenizer = get_model_tokenizer(model_id_or_path, model_type=model_type)

logger.info(f'model_info: {model.model_info}')

template = get_template(model.model_meta.template, tokenizer, default_system=system, max_length=max_length)

template.set_mode('train')[INFO:swift] model_info: ModelInfo(model_type='qwq', model_dir='/data1/models/QwQ-32B-unsloth-bnb-4bit', torch_dtype=torch.bfloat16, max_model_len=131072, quant_method='bnb', quant_bits=4, rope_scaling=None, config=Qwen2Config {"_attn_implementation_autoset": true,"architectures": ["Qwen2ForCausalLM"],"attention_dropout": 0.0,"eos_token_id": 151645,"hidden_act": "silu","hidden_size": 5120,"initializer_range": 0.02,"intermediate_size": 27648,"max_position_embeddings": 131072,"max_window_layers": 64,"model_type": "qwen2","num_attention_heads": 40,"num_hidden_layers": 64,"num_key_value_heads": 8,"pad_token_id": 151654,"quantization_config": {"_load_in_4bit": true,"_load_in_8bit": false,"bnb_4bit_compute_dtype": "bfloat16","bnb_4bit_quant_storage": "uint8","bnb_4bit_quant_type": "nf4","bnb_4bit_use_double_quant": true,"llm_int8_enable_fp32_cpu_offload": false,"llm_int8_has_fp16_weight": false,"llm_int8_skip_modules": ["lm_head","multi_modal_projector","merger","modality_projection","model.layers.4.mlp","model.layers.0.mlp","model.layers.60.mlp","model.layers.62.mlp","model.layers.5.mlp","model.layers.43.self_attn"],"llm_int8_threshold": 6.0,"load_in_4bit": true,"load_in_8bit": false,"quant_method": "bitsandbytes"},"rms_norm_eps": 1e-05,"rope_scaling": null,"rope_theta": 1000000.0,"sliding_window": 32768,"tie_word_embeddings": false,"torch_dtype": "bfloat16","transformers_version": "4.50.2","unsloth_fixed": true,"use_cache": true,"use_sliding_window": false,"vocab_size": 152064

}

, task_type='causal_lm', num_labels=None)微调参数设置

target_modules = find_all_linears(model)

lora_config = LoraConfig(task_type='CAUSAL_LM', r=lora_rank, lora_alpha=lora_alpha,target_modules=target_modules)

model = Swift.prepare_model(model, lora_config)

logger.info(f'lora_config: {lora_config}')

查看微调设置

# 打印模型结构和训练的参数量

logger.info(f'model: {model}')

model_parameter_info = get_model_parameter_info(model)

logger.info(f'model_parameter_info: {model_parameter_info}')[INFO:swift] model: PeftModelForCausalLM((base_model): LoraModel((model): Qwen2ForCausalLM((model): Qwen2Model((embed_tokens): Embedding(152064, 5120, padding_idx=151654)(layers): ModuleList((0): Qwen2DecoderLayer((self_attn): Qwen2Attention((q_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(k_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(v_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(o_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict()))(mlp): Qwen2MLP((gate_proj): Linear(in_features=5120, out_features=27648, bias=False)(up_proj): Linear(in_features=5120, out_features=27648, bias=False)(down_proj): Linear(in_features=27648, out_features=5120, bias=False)(act_fn): SiLU())(input_layernorm): Qwen2RMSNorm((5120,), eps=1e-05)(post_attention_layernorm): Qwen2RMSNorm((5120,), eps=1e-05))(1-3): 3 x Qwen2DecoderLayer((self_attn): Qwen2Attention((q_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(k_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(v_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(o_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict()))(mlp): Qwen2MLP((gate_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=27648, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=27648, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(up_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=27648, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=27648, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(down_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=27648, out_features=5120, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=27648, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(act_fn): SiLU())(input_layernorm): Qwen2RMSNorm((5120,), eps=1e-05)(post_attention_layernorm): Qwen2RMSNorm((5120,), eps=1e-05))(4-5): 2 x Qwen2DecoderLayer((self_attn): Qwen2Attention((q_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(k_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(v_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(o_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict()))(mlp): Qwen2MLP((gate_proj): Linear(in_features=5120, out_features=27648, bias=False)(up_proj): Linear(in_features=5120, out_features=27648, bias=False)(down_proj): Linear(in_features=27648, out_features=5120, bias=False)(act_fn): SiLU())(input_layernorm): Qwen2RMSNorm((5120,), eps=1e-05)(post_attention_layernorm): Qwen2RMSNorm((5120,), eps=1e-05))(6-42): 37 x Qwen2DecoderLayer((self_attn): Qwen2Attention((q_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(k_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(v_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(o_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict()))(mlp): Qwen2MLP((gate_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=27648, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=27648, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(up_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=27648, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=27648, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(down_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=27648, out_features=5120, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=27648, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(act_fn): SiLU())(input_layernorm): Qwen2RMSNorm((5120,), eps=1e-05)(post_attention_layernorm): Qwen2RMSNorm((5120,), eps=1e-05))(43): Qwen2DecoderLayer((self_attn): Qwen2Attention((q_proj): Linear(in_features=5120, out_features=5120, bias=True)(k_proj): Linear(in_features=5120, out_features=1024, bias=True)(v_proj): Linear(in_features=5120, out_features=1024, bias=True)(o_proj): Linear(in_features=5120, out_features=5120, bias=False))(mlp): Qwen2MLP((gate_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=27648, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=27648, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(up_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=27648, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=27648, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(down_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=27648, out_features=5120, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=27648, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(act_fn): SiLU())(input_layernorm): Qwen2RMSNorm((5120,), eps=1e-05)(post_attention_layernorm): Qwen2RMSNorm((5120,), eps=1e-05))(44-59): 16 x Qwen2DecoderLayer((self_attn): Qwen2Attention((q_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(k_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(v_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(o_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict()))(mlp): Qwen2MLP((gate_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=27648, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=27648, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(up_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=27648, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=27648, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(down_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=27648, out_features=5120, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=27648, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(act_fn): SiLU())(input_layernorm): Qwen2RMSNorm((5120,), eps=1e-05)(post_attention_layernorm): Qwen2RMSNorm((5120,), eps=1e-05))(60): Qwen2DecoderLayer((self_attn): Qwen2Attention((q_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(k_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(v_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(o_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict()))(mlp): Qwen2MLP((gate_proj): Linear(in_features=5120, out_features=27648, bias=False)(up_proj): Linear(in_features=5120, out_features=27648, bias=False)(down_proj): Linear(in_features=27648, out_features=5120, bias=False)(act_fn): SiLU())(input_layernorm): Qwen2RMSNorm((5120,), eps=1e-05)(post_attention_layernorm): Qwen2RMSNorm((5120,), eps=1e-05))(61): Qwen2DecoderLayer((self_attn): Qwen2Attention((q_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(k_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(v_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(o_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict()))(mlp): Qwen2MLP((gate_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=27648, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=27648, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(up_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=27648, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=27648, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(down_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=27648, out_features=5120, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=27648, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(act_fn): SiLU())(input_layernorm): Qwen2RMSNorm((5120,), eps=1e-05)(post_attention_layernorm): Qwen2RMSNorm((5120,), eps=1e-05))(62): Qwen2DecoderLayer((self_attn): Qwen2Attention((q_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(k_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(v_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(o_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict()))(mlp): Qwen2MLP((gate_proj): Linear(in_features=5120, out_features=27648, bias=False)(up_proj): Linear(in_features=5120, out_features=27648, bias=False)(down_proj): Linear(in_features=27648, out_features=5120, bias=False)(act_fn): SiLU())(input_layernorm): Qwen2RMSNorm((5120,), eps=1e-05)(post_attention_layernorm): Qwen2RMSNorm((5120,), eps=1e-05))(63): Qwen2DecoderLayer((self_attn): Qwen2Attention((q_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(k_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(v_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=1024, bias=True)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=1024, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(o_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=5120, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict()))(mlp): Qwen2MLP((gate_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=27648, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=27648, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(up_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=5120, out_features=27648, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=5120, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=27648, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(down_proj): lora.Linear4bit((base_layer): Linear4bit(in_features=27648, out_features=5120, bias=False)(lora_dropout): ModuleDict((default): Identity())(lora_A): ModuleDict((default): Linear(in_features=27648, out_features=8, bias=False))(lora_B): ModuleDict((default): Linear(in_features=8, out_features=5120, bias=False))(lora_embedding_A): ParameterDict()(lora_embedding_B): ParameterDict()(lora_magnitude_vector): ModuleDict())(act_fn): SiLU())(input_layernorm): Qwen2RMSNorm((5120,), eps=1e-05)(post_attention_layernorm): Qwen2RMSNorm((5120,), eps=1e-05)))(norm): Qwen2RMSNorm((5120,), eps=1e-05)(rotary_emb): Qwen2RotaryEmbedding())(lm_head): Linear(in_features=5120, out_features=152064, bias=False)))

)

[INFO:swift] model_parameter_info: PeftModelForCausalLM: 18317.1205M Params (62.9146M Trainable [0.3435%]), 0.0001M Buffers.加载数据集

train_dataset, val_dataset = load_dataset(dataset, split_dataset_ratio=split_dataset_ratio, num_proc=num_proc, seed=data_seed)

这里选取1000条来进行演示

Map (num_proc=4): 0%| | 0/1000 [00:00<?, ? examples/s]

logger.info(f'train_dataset: {train_dataset}')

logger.info(f'val_dataset: {val_dataset}')

logger.info(f'train_dataset[0]: {train_dataset[0]}')train_dataset = EncodePreprocessor(template=template)(train_dataset, num_proc=num_proc)

val_dataset = EncodePreprocessor(template=template)(val_dataset, num_proc=num_proc)

logger.info(f'encoded_train_dataset[0]: {train_dataset[0]}')# 打印一条样本

template.print_inputs(train_dataset[0])[INFO:swift] Dataset filtered, origin length: 10, filtered dataset length: 9

[INFO:swift] encoded_train_dataset[0]: {'input_ids': [151644, 8948, 198, 2610, 525, 264, 10950, 17847, 13, 151645, 198, 151644, 872, 198, 115909, 17, 23, 17, 18538, 3837, 30709, 101253, 102336, 22, 35727, 33447, 3837, 100626, 23, 21, 18538, 70927, 107057, 3837, 30709, 101253, 101200, 101922, 50930, 100430, 18538, 11319, 151645, 198, 151644, 77091, 198, 151667, 110115, 3837, 107520, 109075, 46944, 104552, 86119, 3837, 49828, 104857, 99172, 14777, 99172, 99494, 100638, 1773, 106367, 20412, 36587, 3837, 115909, 18830, 17, 23, 17, 18538, 3837, 30709, 101253, 102336, 22, 35727, 33447, 3837, 97706, 100124, 23, 21, 18538, 70927, 50930, 1773, 99212, 99517, 101200, 101922, 102336, 100430, 18538, 101036, 11319, 106287, 3837, 104029, 101283, 21887, 101222, 105652, 3407, 101140, 3837, 35946, 49828, 60610, 59743, 18538, 8863, 33108, 108719, 18538, 8863, 1773, 106367, 69249, 36587, 59743, 104678, 17, 23, 17, 18538, 3837, 102336, 22, 35727, 33447, 111392, 23, 21, 18538, 1773, 99212, 108443, 69103, 100146, 102332, 22, 35727, 69249, 3837, 30709, 101253, 111531, 102336, 100430, 18538, 32664, 100003, 11319, 107864, 106760, 3837, 99519, 101200, 101922, 50930, 9370, 18538, 8863, 99486, 99487, 107737, 20755, 23031, 35727, 8863, 3407, 99212, 35946, 104074, 99730, 11622, 59743, 18538, 8863, 99536, 85336, 108719, 18538, 8863, 36407, 101051, 99461, 50930, 105565, 18538, 8863, 101036, 11319, 106998, 3837, 59743, 18538, 8863, 17, 23, 17, 18538, 99536, 85336, 108719, 23, 21, 18538, 3837, 99486, 99461, 50930, 107625, 1773, 99212, 99654, 100768, 100363, 3837, 17, 23, 17, 99536, 85336, 23, 21, 107106, 100430, 101036, 11319, 104029, 69103, 100158, 5122, 17, 23, 17, 99536, 23, 15, 20412, 17, 15, 17, 3837, 87256, 99536, 21, 100363, 20412, 16, 24, 21, 1773, 99999, 30709, 101253, 18493, 22, 35727, 69249, 102336, 16, 24, 21, 18538, 26850, 101889, 104326, 3837, 101200, 101922, 50930, 9370, 18538, 8863, 99486, 111531, 50930, 9370, 18538, 8863, 20755, 23031, 35727, 8863, 3837, 102200, 16, 24, 21, 18538, 20755, 23031, 22, 35727, 32664, 100003, 11319, 106436, 85106, 100768, 16, 24, 21, 20755, 23031, 22, 105369, 1773, 104029, 105839, 3837, 22, 100252, 17, 23, 107106, 16, 24, 21, 3837, 99999, 16, 24, 21, 20755, 23031, 22, 107106, 17, 23, 1773, 99999, 30709, 101253, 101200, 101922, 102336, 17, 23, 18538, 26850, 100632, 3837, 35946, 99730, 101071, 100158, 100768, 64471, 88991, 3837, 101153, 101314, 20221, 28726, 1773, 101912, 109331, 9370, 59743, 18538, 8863, 99536, 85336, 107989, 18538, 8863, 64471, 88991, 1773, 87256, 69103, 107060, 5122, 17, 23, 17, 99536, 23, 21, 1773, 18947, 24156, 17447, 17, 99536, 21, 104222, 3837, 69041, 94498, 24156, 99588, 16, 3837, 104286, 16, 17, 99536, 21, 107106, 21, 3837, 94498, 24156, 17447, 108775, 23, 99250, 99588, 34187, 16, 3837, 111392, 22, 3837, 87256, 99536, 23, 3837, 106436, 99518, 104222, 99536, 3837, 69041, 99271, 24156, 99588, 16, 3837, 99271, 24156, 9370, 17, 104286, 16, 3837, 94498, 24156, 104286, 16, 22, 99536, 23, 107106, 24, 3837, 99271, 24156, 104286, 16, 99536, 15, 3837, 99999, 59151, 20412, 16, 24, 21, 3837, 114815, 3407, 101889, 16, 24, 21, 20755, 23031, 22, 3837, 22, 100252, 17, 15, 20412, 16, 19, 15, 3837, 22, 100252, 17, 23, 20412, 16, 19, 15, 20929, 20, 21, 107106, 16, 24, 21, 3837, 99999, 59151, 88991, 1773, 99212, 102349, 99486, 17, 23, 18538, 101922, 1773, 100632, 104710, 87267, 101314, 70927, 106350, 11319, 101912, 106367, 104710, 92894, 71694, 105427, 26850, 101912, 106367, 69249, 104710, 104496, 43288, 22, 35727, 69249, 101922, 50930, 9370, 64471, 20412, 63431, 8863, 18538, 11319, 100631, 64471, 104139, 116848, 3837, 101912, 100161, 100729, 87267, 70927, 107057, 104489, 9370, 32757, 11319, 100632, 106367, 69249, 112736, 101200, 101922, 50930, 9370, 32757, 3837, 99999, 99730, 11622, 59743, 18538, 8863, 20755, 23031, 35727, 8863, 3837, 101260, 101922, 106708, 99559, 100007, 3837, 99999, 106370, 100768, 106273, 9370, 3407, 87256, 81167, 107060, 86119, 9370, 101284, 20074, 5122, 59743, 18538, 8863, 17, 23, 17, 3837, 108719, 23, 21, 3837, 99999, 99461, 50930, 100146, 17, 23, 17, 12, 23, 21, 28, 16, 24, 21, 18538, 1773, 22, 35727, 101975, 3837, 16, 24, 21, 20755, 23031, 22, 107106, 17, 23, 1773, 99654, 107522, 9370, 106073, 106273, 9370, 1773, 99999, 99730, 109012, 100003, 26850, 106287, 3837, 102135, 99487, 100178, 106273, 9370, 3837, 80443, 86119, 1773, 99999, 30709, 101253, 101200, 101922, 102336, 17, 23, 18538, 8997, 151668, 1022, 115909, 104678, 17, 23, 17, 18538, 3837, 30709, 101253, 102336, 22, 35727, 33447, 97706, 111392, 23, 21, 18538, 1773, 30534, 100768, 99517, 101200, 101922, 50930, 9370, 18538, 8863, 3837, 105652, 104506, 48443, 16, 13, 3070, 100768, 36667, 50930, 9370, 18538, 8863, 334, 5122, 59743, 18538, 8863, 99536, 85336, 107989, 18538, 8863, 3837, 91676, 2303, 256, 17767, 220, 17, 23, 17, 481, 220, 23, 21, 284, 220, 16, 24, 21, 1124, 8, 220, 18538, 3407, 17, 13, 3070, 30918, 101200, 101922, 50930, 9370, 18538, 8863, 334, 5122, 44063, 36667, 50930, 18538, 8863, 20755, 23031, 35727, 8863, 3837, 91676, 2303, 256, 17767, 220, 16, 24, 21, 1124, 611, 220, 22, 284, 220, 17, 23, 1124, 8, 220, 18538, 14, 35727, 3407, 48927, 100768, 100178, 5122, 2303, 12, 90476, 119, 18538, 8863, 17, 23, 17, 99536, 107989, 23, 21, 18538, 102068, 107106, 16, 24, 21, 18538, 9909, 44292, 17, 23, 17, 481, 220, 23, 15, 284, 220, 17, 15, 17, 57758, 3837, 87256, 99536, 21, 49828, 16, 24, 21, 74276, 2303, 12, 220, 16, 24, 21, 20755, 23031, 22, 13343, 3837, 22, 17568, 17, 23, 28, 16, 24, 21, 3837, 100768, 88991, 3407, 101886, 3837, 30709, 101253, 101200, 101922, 50930, 1124, 79075, 90, 17, 23, 92, 220, 18538, 1773, 151645], 'labels': [-100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, 151667, 110115, 3837, 107520, 109075, 46944, 104552, 86119, 3837, 49828, 104857, 99172, 14777, 99172, 99494, 100638, 1773, 106367, 20412, 36587, 3837, 115909, 18830, 17, 23, 17, 18538, 3837, 30709, 101253, 102336, 22, 35727, 33447, 3837, 97706, 100124, 23, 21, 18538, 70927, 50930, 1773, 99212, 99517, 101200, 101922, 102336, 100430, 18538, 101036, 11319, 106287, 3837, 104029, 101283, 21887, 101222, 105652, 3407, 101140, 3837, 35946, 49828, 60610, 59743, 18538, 8863, 33108, 108719, 18538, 8863, 1773, 106367, 69249, 36587, 59743, 104678, 17, 23, 17, 18538, 3837, 102336, 22, 35727, 33447, 111392, 23, 21, 18538, 1773, 99212, 108443, 69103, 100146, 102332, 22, 35727, 69249, 3837, 30709, 101253, 111531, 102336, 100430, 18538, 32664, 100003, 11319, 107864, 106760, 3837, 99519, 101200, 101922, 50930, 9370, 18538, 8863, 99486, 99487, 107737, 20755, 23031, 35727, 8863, 3407, 99212, 35946, 104074, 99730, 11622, 59743, 18538, 8863, 99536, 85336, 108719, 18538, 8863, 36407, 101051, 99461, 50930, 105565, 18538, 8863, 101036, 11319, 106998, 3837, 59743, 18538, 8863, 17, 23, 17, 18538, 99536, 85336, 108719, 23, 21, 18538, 3837, 99486, 99461, 50930, 107625, 1773, 99212, 99654, 100768, 100363, 3837, 17, 23, 17, 99536, 85336, 23, 21, 107106, 100430, 101036, 11319, 104029, 69103, 100158, 5122, 17, 23, 17, 99536, 23, 15, 20412, 17, 15, 17, 3837, 87256, 99536, 21, 100363, 20412, 16, 24, 21, 1773, 99999, 30709, 101253, 18493, 22, 35727, 69249, 102336, 16, 24, 21, 18538, 26850, 101889, 104326, 3837, 101200, 101922, 50930, 9370, 18538, 8863, 99486, 111531, 50930, 9370, 18538, 8863, 20755, 23031, 35727, 8863, 3837, 102200, 16, 24, 21, 18538, 20755, 23031, 22, 35727, 32664, 100003, 11319, 106436, 85106, 100768, 16, 24, 21, 20755, 23031, 22, 105369, 1773, 104029, 105839, 3837, 22, 100252, 17, 23, 107106, 16, 24, 21, 3837, 99999, 16, 24, 21, 20755, 23031, 22, 107106, 17, 23, 1773, 99999, 30709, 101253, 101200, 101922, 102336, 17, 23, 18538, 26850, 100632, 3837, 35946, 99730, 101071, 100158, 100768, 64471, 88991, 3837, 101153, 101314, 20221, 28726, 1773, 101912, 109331, 9370, 59743, 18538, 8863, 99536, 85336, 107989, 18538, 8863, 64471, 88991, 1773, 87256, 69103, 107060, 5122, 17, 23, 17, 99536, 23, 21, 1773, 18947, 24156, 17447, 17, 99536, 21, 104222, 3837, 69041, 94498, 24156, 99588, 16, 3837, 104286, 16, 17, 99536, 21, 107106, 21, 3837, 94498, 24156, 17447, 108775, 23, 99250, 99588, 34187, 16, 3837, 111392, 22, 3837, 87256, 99536, 23, 3837, 106436, 99518, 104222, 99536, 3837, 69041, 99271, 24156, 99588, 16, 3837, 99271, 24156, 9370, 17, 104286, 16, 3837, 94498, 24156, 104286, 16, 22, 99536, 23, 107106, 24, 3837, 99271, 24156, 104286, 16, 99536, 15, 3837, 99999, 59151, 20412, 16, 24, 21, 3837, 114815, 3407, 101889, 16, 24, 21, 20755, 23031, 22, 3837, 22, 100252, 17, 15, 20412, 16, 19, 15, 3837, 22, 100252, 17, 23, 20412, 16, 19, 15, 20929, 20, 21, 107106, 16, 24, 21, 3837, 99999, 59151, 88991, 1773, 99212, 102349, 99486, 17, 23, 18538, 101922, 1773, 100632, 104710, 87267, 101314, 70927, 106350, 11319, 101912, 106367, 104710, 92894, 71694, 105427, 26850, 101912, 106367, 69249, 104710, 104496, 43288, 22, 35727, 69249, 101922, 50930, 9370, 64471, 20412, 63431, 8863, 18538, 11319, 100631, 64471, 104139, 116848, 3837, 101912, 100161, 100729, 87267, 70927, 107057, 104489, 9370, 32757, 11319, 100632, 106367, 69249, 112736, 101200, 101922, 50930, 9370, 32757, 3837, 99999, 99730, 11622, 59743, 18538, 8863, 20755, 23031, 35727, 8863, 3837, 101260, 101922, 106708, 99559, 100007, 3837, 99999, 106370, 100768, 106273, 9370, 3407, 87256, 81167, 107060, 86119, 9370, 101284, 20074, 5122, 59743, 18538, 8863, 17, 23, 17, 3837, 108719, 23, 21, 3837, 99999, 99461, 50930, 100146, 17, 23, 17, 12, 23, 21, 28, 16, 24, 21, 18538, 1773, 22, 35727, 101975, 3837, 16, 24, 21, 20755, 23031, 22, 107106, 17, 23, 1773, 99654, 107522, 9370, 106073, 106273, 9370, 1773, 99999, 99730, 109012, 100003, 26850, 106287, 3837, 102135, 99487, 100178, 106273, 9370, 3837, 80443, 86119, 1773, 99999, 30709, 101253, 101200, 101922, 102336, 17, 23, 18538, 8997, 151668, 1022, 115909, 104678, 17, 23, 17, 18538, 3837, 30709, 101253, 102336, 22, 35727, 33447, 97706, 111392, 23, 21, 18538, 1773, 30534, 100768, 99517, 101200, 101922, 50930, 9370, 18538, 8863, 3837, 105652, 104506, 48443, 16, 13, 3070, 100768, 36667, 50930, 9370, 18538, 8863, 334, 5122, 59743, 18538, 8863, 99536, 85336, 107989, 18538, 8863, 3837, 91676, 2303, 256, 17767, 220, 17, 23, 17, 481, 220, 23, 21, 284, 220, 16, 24, 21, 1124, 8, 220, 18538, 3407, 17, 13, 3070, 30918, 101200, 101922, 50930, 9370, 18538, 8863, 334, 5122, 44063, 36667, 50930, 18538, 8863, 20755, 23031, 35727, 8863, 3837, 91676, 2303, 256, 17767, 220, 16, 24, 21, 1124, 611, 220, 22, 284, 220, 17, 23, 1124, 8, 220, 18538, 14, 35727, 3407, 48927, 100768, 100178, 5122, 2303, 12, 90476, 119, 18538, 8863, 17, 23, 17, 99536, 107989, 23, 21, 18538, 102068, 107106, 16, 24, 21, 18538, 9909, 44292, 17, 23, 17, 481, 220, 23, 15, 284, 220, 17, 15, 17, 57758, 3837, 87256, 99536, 21, 49828, 16, 24, 21, 74276, 2303, 12, 220, 16, 24, 21, 20755, 23031, 22, 13343, 3837, 22, 17568, 17, 23, 28, 16, 24, 21, 3837, 100768, 88991, 3407, 101886, 3837, 30709, 101253, 101200, 101922, 50930, 1124, 79075, 90, 17, 23, 92, 220, 18538, 1773, 151645]}

[INFO:swift] [INPUT_IDS] [151644, 8948, 198, 2610, 525, 264, 10950, 17847, 13, 151645, 198, 151644, 872, 198, 115909, 17, 23, 17, 18538, 3837, 30709, 101253, 102336, 22, 35727, 33447, 3837, 100626, 23, 21, 18538, 70927, 107057, 3837, 30709, 101253, 101200, 101922, 50930, 100430, 18538, 11319, 151645, 198, 151644, 77091, 198, 151667, 110115, 3837, 107520, 109075, 46944, 104552, 86119, 3837, 49828, 104857, 99172, 14777, 99172, 99494, 100638, 1773, 106367, 20412, 36587, 3837, 115909, 18830, 17, 23, 17, 18538, 3837, 30709, 101253, 102336, 22, 35727, 33447, 3837, 97706, 100124, 23, 21, 18538, 70927, 50930, 1773, 99212, 99517, 101200, 101922, 102336, 100430, 18538, 101036, 11319, 106287, 3837, 104029, 101283, 21887, 101222, 105652, 3407, 101140, 3837, 35946, 49828, 60610, 59743, 18538, 8863, 33108, 108719, 18538, 8863, 1773, 106367, 69249, 36587, 59743, 104678, 17, 23, 17, 18538, 3837, 102336, 22, 35727, 33447, 111392, 23, 21, 18538, 1773, 99212, 108443, 69103, 100146, 102332, 22, 35727, 69249, 3837, 30709, 101253, 111531, 102336, 100430, 18538, 32664, 100003, 11319, 107864, 106760, 3837, 99519, 101200, 101922, 50930, 9370, 18538, 8863, 99486, 99487, 107737, 20755, 23031, 35727, 8863, 3407, 99212, 35946, 104074, 99730, 11622, 59743, 18538, 8863, 99536, 85336, 108719, 18538, 8863, 36407, 101051, 99461, 50930, 105565, 18538, 8863, 101036, 11319, 106998, 3837, 59743, 18538, 8863, 17, 23, 17, 18538, 99536, 85336, 108719, 23, 21, 18538, 3837, 99486, 99461, 50930, 107625, 1773, 99212, 99654, 100768, 100363, 3837, 17, 23, 17, 99536, 85336, 23, 21, 107106, 100430, 101036, 11319, 104029, 69103, 100158, 5122, 17, 23, 17, 99536, 23, 15, 20412, 17, 15, 17, 3837, 87256, 99536, 21, 100363, 20412, 16, 24, 21, 1773, 99999, 30709, 101253, 18493, 22, 35727, 69249, 102336, 16, 24, 21, 18538, 26850, 101889, 104326, 3837, 101200, 101922, 50930, 9370, 18538, 8863, 99486, 111531, 50930, 9370, 18538, 8863, 20755, 23031, 35727, 8863, 3837, 102200, 16, 24, 21, 18538, 20755, 23031, 22, 35727, 32664, 100003, 11319, 106436, 85106, 100768, 16, 24, 21, 20755, 23031, 22, 105369, 1773, 104029, 105839, 3837, 22, 100252, 17, 23, 107106, 16, 24, 21, 3837, 99999, 16, 24, 21, 20755, 23031, 22, 107106, 17, 23, 1773, 99999, 30709, 101253, 101200, 101922, 102336, 17, 23, 18538, 26850, 100632, 3837, 35946, 99730, 101071, 100158, 100768, 64471, 88991, 3837, 101153, 101314, 20221, 28726, 1773, 101912, 109331, 9370, 59743, 18538, 8863, 99536, 85336, 107989, 18538, 8863, 64471, 88991, 1773, 87256, 69103, 107060, 5122, 17, 23, 17, 99536, 23, 21, 1773, 18947, 24156, 17447, 17, 99536, 21, 104222, 3837, 69041, 94498, 24156, 99588, 16, 3837, 104286, 16, 17, 99536, 21, 107106, 21, 3837, 94498, 24156, 17447, 108775, 23, 99250, 99588, 34187, 16, 3837, 111392, 22, 3837, 87256, 99536, 23, 3837, 106436, 99518, 104222, 99536, 3837, 69041, 99271, 24156, 99588, 16, 3837, 99271, 24156, 9370, 17, 104286, 16, 3837, 94498, 24156, 104286, 16, 22, 99536, 23, 107106, 24, 3837, 99271, 24156, 104286, 16, 99536, 15, 3837, 99999, 59151, 20412, 16, 24, 21, 3837, 114815, 3407, 101889, 16, 24, 21, 20755, 23031, 22, 3837, 22, 100252, 17, 15, 20412, 16, 19, 15, 3837, 22, 100252, 17, 23, 20412, 16, 19, 15, 20929, 20, 21, 107106, 16, 24, 21, 3837, 99999, 59151, 88991, 1773, 99212, 102349, 99486, 17, 23, 18538, 101922, 1773, 100632, 104710, 87267, 101314, 70927, 106350, 11319, 101912, 106367, 104710, 92894, 71694, 105427, 26850, 101912, 106367, 69249, 104710, 104496, 43288, 22, 35727, 69249, 101922, 50930, 9370, 64471, 20412, 63431, 8863, 18538, 11319, 100631, 64471, 104139, 116848, 3837, 101912, 100161, 100729, 87267, 70927, 107057, 104489, 9370, 32757, 11319, 100632, 106367, 69249, 112736, 101200, 101922, 50930, 9370, 32757, 3837, 99999, 99730, 11622, 59743, 18538, 8863, 20755, 23031, 35727, 8863, 3837, 101260, 101922, 106708, 99559, 100007, 3837, 99999, 106370, 100768, 106273, 9370, 3407, 87256, 81167, 107060, 86119, 9370, 101284, 20074, 5122, 59743, 18538, 8863, 17, 23, 17, 3837, 108719, 23, 21, 3837, 99999, 99461, 50930, 100146, 17, 23, 17, 12, 23, 21, 28, 16, 24, 21, 18538, 1773, 22, 35727, 101975, 3837, 16, 24, 21, 20755, 23031, 22, 107106, 17, 23, 1773, 99654, 107522, 9370, 106073, 106273, 9370, 1773, 99999, 99730, 109012, 100003, 26850, 106287, 3837, 102135, 99487, 100178, 106273, 9370, 3837, 80443, 86119, 1773, 99999, 30709, 101253, 101200, 101922, 102336, 17, 23, 18538, 8997, 151668, 1022, 115909, 104678, 17, 23, 17, 18538, 3837, 30709, 101253, 102336, 22, 35727, 33447, 97706, 111392, 23, 21, 18538, 1773, 30534, 100768, 99517, 101200, 101922, 50930, 9370, 18538, 8863, 3837, 105652, 104506, 48443, 16, 13, 3070, 100768, 36667, 50930, 9370, 18538, 8863, 334, 5122, 59743, 18538, 8863, 99536, 85336, 107989, 18538, 8863, 3837, 91676, 2303, 256, 17767, 220, 17, 23, 17, 481, 220, 23, 21, 284, 220, 16, 24, 21, 1124, 8, 220, 18538, 3407, 17, 13, 3070, 30918, 101200, 101922, 50930, 9370, 18538, 8863, 334, 5122, 44063, 36667, 50930, 18538, 8863, 20755, 23031, 35727, 8863, 3837, 91676, 2303, 256, 17767, 220, 16, 24, 21, 1124, 611, 220, 22, 284, 220, 17, 23, 1124, 8, 220, 18538, 14, 35727, 3407, 48927, 100768, 100178, 5122, 2303, 12, 90476, 119, 18538, 8863, 17, 23, 17, 99536, 107989, 23, 21, 18538, 102068, 107106, 16, 24, 21, 18538, 9909, 44292, 17, 23, 17, 481, 220, 23, 15, 284, 220, 17, 15, 17, 57758, 3837, 87256, 99536, 21, 49828, 16, 24, 21, 74276, 2303, 12, 220, 16, 24, 21, 20755, 23031, 22, 13343, 3837, 22, 17568, 17, 23, 28, 16, 24, 21, 3837, 100768, 88991, 3407, 101886, 3837, 30709, 101253, 101200, 101922, 50930, 1124, 79075, 90, 17, 23, 92, 220, 18538, 1773, 151645]

[INFO:swift] [INPUT] <|im_start|>system

You are a helpful assistant.<|im_end|>

<|im_start|>user

一本书282页,小辉看了7天后,还有86页没看完,小辉平均每天看多少页?<|im_end|>

<|im_start|>assistant

<think>好吧,我现在遇到了一个数学问题,得仔细想一想怎么解决。题目是说,一本书有282页,小辉看了7天后,还剩86页没看。那她平均每天看了多少页呢?嗯,让我慢慢理清楚步骤。首先,我得确定总页数和剩下的页数。题目里说总共有282页,看了7天后剩下86页。那首先要算的是在这7天里,小辉总共看了多少页对吧?这点很重要,因为平均每天看的页数就是这个总数除以天数。那我是不是应该用总页数减去剩下的页数来得到已经看过的页数呢?比如说,总页数282页减去剩下的86页,就是已经看的部分。那这样计算的话,282减去86等于多少呢?让我算一下:282减80是202,再减6的话是196。所以小辉在7天里看了196页?然后接下来,平均每天看的页数就是总共看的页数除以天数,也就是196页除以7天对吧?这时候需要计算196除以7的结果。让我想想,7乘28等于196,所以196除以7等于28。所以小辉平均每天看了28页?不过,我应该检查一下计算是否正确,避免哪里出错。比如第一步的总页数减去剩余页数是否正确。再算一遍:282减86。个位上2减6不够,向十位借1,变成12减6等于6,十位上原来的8被借了1,剩下7,再减8,这时候又不够减,向百位借1,百位的2变成1,十位变成17减8等于9,百位变成1减0,所以结果是196,没问题。然后196除以7,7乘20是140,7乘28是140加56等于196,所以结果正确。那答案就是28页每天。不过有没有可能哪里没考虑到?比如题目有没有其他隐藏的信息?比如题目里有没有提到这7天里每天看的是否是整数页?或者是否有什么特殊情况,比如最后一天可能没看完当天的量?不过题目里说的是平均每天看的量,所以应该用总页数除以天数,不管每天的具体情况如何,所以这里的计算是对的。再确认一遍问题的各个数据:总页数282,剩下的86,所以已经看的是282-86=196页。7天的时间,196除以7等于28。这样得出的结论是对的。所以应该没错吧?嗯,看来这个过程是对的,没有问题。所以小辉平均每天看了28页。

</think>一本书共有282页,小辉看了7天后还剩下86页。要计算她平均每天看的页数,步骤如下:1. **计算已看的页数**:总页数减去剩余页数,即 \( 282 - 86 = 196 \) 页。2. **求平均每天看的页数**:将已看页数除以天数,即 \( 196 \div 7 = 28 \) 页/天。验证计算过程:

- 总页数282减剩余86页确实等于196页(\(282 - 80 = 202\),再减6得196)。

- 196除以7时,7×28=196,计算正确。因此,小辉平均每天看 \boxed{28} 页。<|im_end|>

[INFO:swift] [LABELS_IDS] [-100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, -100, 151667, 110115, 3837, 107520, 109075, 46944, 104552, 86119, 3837, 49828, 104857, 99172, 14777, 99172, 99494, 100638, 1773, 106367, 20412, 36587, 3837, 115909, 18830, 17, 23, 17, 18538, 3837, 30709, 101253, 102336, 22, 35727, 33447, 3837, 97706, 100124, 23, 21, 18538, 70927, 50930, 1773, 99212, 99517, 101200, 101922, 102336, 100430, 18538, 101036, 11319, 106287, 3837, 104029, 101283, 21887, 101222, 105652, 3407, 101140, 3837, 35946, 49828, 60610, 59743, 18538, 8863, 33108, 108719, 18538, 8863, 1773, 106367, 69249, 36587, 59743, 104678, 17, 23, 17, 18538, 3837, 102336, 22, 35727, 33447, 111392, 23, 21, 18538, 1773, 99212, 108443, 69103, 100146, 102332, 22, 35727, 69249, 3837, 30709, 101253, 111531, 102336, 100430, 18538, 32664, 100003, 11319, 107864, 106760, 3837, 99519, 101200, 101922, 50930, 9370, 18538, 8863, 99486, 99487, 107737, 20755, 23031, 35727, 8863, 3407, 99212, 35946, 104074, 99730, 11622, 59743, 18538, 8863, 99536, 85336, 108719, 18538, 8863, 36407, 101051, 99461, 50930, 105565, 18538, 8863, 101036, 11319, 106998, 3837, 59743, 18538, 8863, 17, 23, 17, 18538, 99536, 85336, 108719, 23, 21, 18538, 3837, 99486, 99461, 50930, 107625, 1773, 99212, 99654, 100768, 100363, 3837, 17, 23, 17, 99536, 85336, 23, 21, 107106, 100430, 101036, 11319, 104029, 69103, 100158, 5122, 17, 23, 17, 99536, 23, 15, 20412, 17, 15, 17, 3837, 87256, 99536, 21, 100363, 20412, 16, 24, 21, 1773, 99999, 30709, 101253, 18493, 22, 35727, 69249, 102336, 16, 24, 21, 18538, 26850, 101889, 104326, 3837, 101200, 101922, 50930, 9370, 18538, 8863, 99486, 111531, 50930, 9370, 18538, 8863, 20755, 23031, 35727, 8863, 3837, 102200, 16, 24, 21, 18538, 20755, 23031, 22, 35727, 32664, 100003, 11319, 106436, 85106, 100768, 16, 24, 21, 20755, 23031, 22, 105369, 1773, 104029, 105839, 3837, 22, 100252, 17, 23, 107106, 16, 24, 21, 3837, 99999, 16, 24, 21, 20755, 23031, 22, 107106, 17, 23, 1773, 99999, 30709, 101253, 101200, 101922, 102336, 17, 23, 18538, 26850, 100632, 3837, 35946, 99730, 101071, 100158, 100768, 64471, 88991, 3837, 101153, 101314, 20221, 28726, 1773, 101912, 109331, 9370, 59743, 18538, 8863, 99536, 85336, 107989, 18538, 8863, 64471, 88991, 1773, 87256, 69103, 107060, 5122, 17, 23, 17, 99536, 23, 21, 1773, 18947, 24156, 17447, 17, 99536, 21, 104222, 3837, 69041, 94498, 24156, 99588, 16, 3837, 104286, 16, 17, 99536, 21, 107106, 21, 3837, 94498, 24156, 17447, 108775, 23, 99250, 99588, 34187, 16, 3837, 111392, 22, 3837, 87256, 99536, 23, 3837, 106436, 99518, 104222, 99536, 3837, 69041, 99271, 24156, 99588, 16, 3837, 99271, 24156, 9370, 17, 104286, 16, 3837, 94498, 24156, 104286, 16, 22, 99536, 23, 107106, 24, 3837, 99271, 24156, 104286, 16, 99536, 15, 3837, 99999, 59151, 20412, 16, 24, 21, 3837, 114815, 3407, 101889, 16, 24, 21, 20755, 23031, 22, 3837, 22, 100252, 17, 15, 20412, 16, 19, 15, 3837, 22, 100252, 17, 23, 20412, 16, 19, 15, 20929, 20, 21, 107106, 16, 24, 21, 3837, 99999, 59151, 88991, 1773, 99212, 102349, 99486, 17, 23, 18538, 101922, 1773, 100632, 104710, 87267, 101314, 70927, 106350, 11319, 101912, 106367, 104710, 92894, 71694, 105427, 26850, 101912, 106367, 69249, 104710, 104496, 43288, 22, 35727, 69249, 101922, 50930, 9370, 64471, 20412, 63431, 8863, 18538, 11319, 100631, 64471, 104139, 116848, 3837, 101912, 100161, 100729, 87267, 70927, 107057, 104489, 9370, 32757, 11319, 100632, 106367, 69249, 112736, 101200, 101922, 50930, 9370, 32757, 3837, 99999, 99730, 11622, 59743, 18538, 8863, 20755, 23031, 35727, 8863, 3837, 101260, 101922, 106708, 99559, 100007, 3837, 99999, 106370, 100768, 106273, 9370, 3407, 87256, 81167, 107060, 86119, 9370, 101284, 20074, 5122, 59743, 18538, 8863, 17, 23, 17, 3837, 108719, 23, 21, 3837, 99999, 99461, 50930, 100146, 17, 23, 17, 12, 23, 21, 28, 16, 24, 21, 18538, 1773, 22, 35727, 101975, 3837, 16, 24, 21, 20755, 23031, 22, 107106, 17, 23, 1773, 99654, 107522, 9370, 106073, 106273, 9370, 1773, 99999, 99730, 109012, 100003, 26850, 106287, 3837, 102135, 99487, 100178, 106273, 9370, 3837, 80443, 86119, 1773, 99999, 30709, 101253, 101200, 101922, 102336, 17, 23, 18538, 8997, 151668, 1022, 115909, 104678, 17, 23, 17, 18538, 3837, 30709, 101253, 102336, 22, 35727, 33447, 97706, 111392, 23, 21, 18538, 1773, 30534, 100768, 99517, 101200, 101922, 50930, 9370, 18538, 8863, 3837, 105652, 104506, 48443, 16, 13, 3070, 100768, 36667, 50930, 9370, 18538, 8863, 334, 5122, 59743, 18538, 8863, 99536, 85336, 107989, 18538, 8863, 3837, 91676, 2303, 256, 17767, 220, 17, 23, 17, 481, 220, 23, 21, 284, 220, 16, 24, 21, 1124, 8, 220, 18538, 3407, 17, 13, 3070, 30918, 101200, 101922, 50930, 9370, 18538, 8863, 334, 5122, 44063, 36667, 50930, 18538, 8863, 20755, 23031, 35727, 8863, 3837, 91676, 2303, 256, 17767, 220, 16, 24, 21, 1124, 611, 220, 22, 284, 220, 17, 23, 1124, 8, 220, 18538, 14, 35727, 3407, 48927, 100768, 100178, 5122, 2303, 12, 90476, 119, 18538, 8863, 17, 23, 17, 99536, 107989, 23, 21, 18538, 102068, 107106, 16, 24, 21, 18538, 9909, 44292, 17, 23, 17, 481, 220, 23, 15, 284, 220, 17, 15, 17, 57758, 3837, 87256, 99536, 21, 49828, 16, 24, 21, 74276, 2303, 12, 220, 16, 24, 21, 20755, 23031, 22, 13343, 3837, 22, 17568, 17, 23, 28, 16, 24, 21, 3837, 100768, 88991, 3407, 101886, 3837, 30709, 101253, 101200, 101922, 50930, 1124, 79075, 90, 17, 23, 92, 220, 18538, 1773, 151645]