获取更多面试真题的集合,请移步至 https://i.afbcs.cn/naPbNY

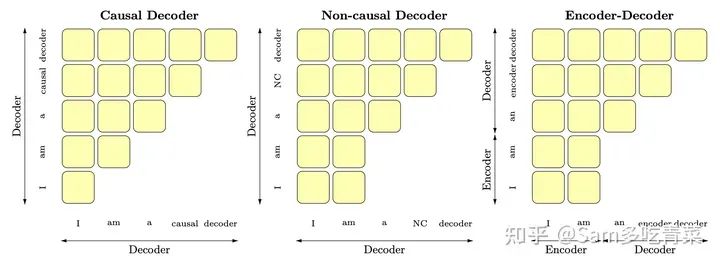

说白了:就是attention mask不一样,如下所示:

img

它们定义如下:

Prefix LM(前缀语言模型):在输入序列的开头添加一个可学习的任务相关的前缀,然后使用这个前缀和输入序列一起生成输出。这种方法可以引导模型生成适应特定任务的输出。

Causal LM(因果语言模型):也称为自回归语言模型,它根据之前生成的 token 预测下一个 token。在生成文本时,模型只能根据已经生成的部分生成后续部分,不能访问未来的信息。