从RAG到记忆:大语言模型的无参数持续学习

原文链接:https://arxiv.org/pdf/2502.14802

Code: https://github.com/OSU-NLP-Group/HippoRAG

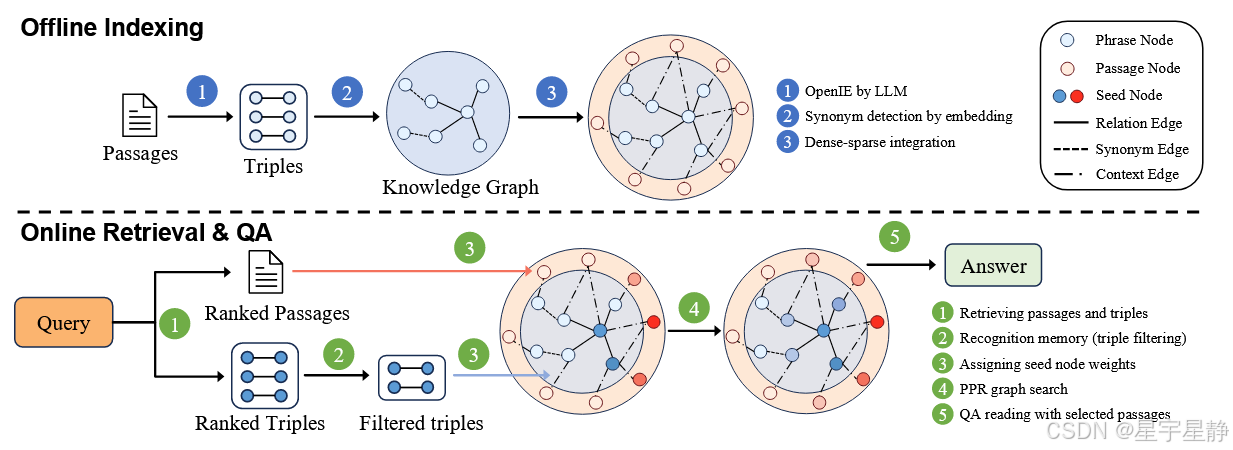

🧠 HippoRAG 2 流程概述

1. 离线索引(Offline Indexing)

在此阶段,HippoRAG 2 构建一个开放式知识图谱(Open KG)以存储知识:

-

三元组提取(Triple Extraction): 使用 LLM(如 GPT-3.5)从文本段落中提取三元组(主语、谓语、宾语),例如从句子“Steve Jobs 于 1976 年共同创立了 Apple”中提取

(Steve Jobs, co-founded, Apple)和(Apple, founded_in, 1976)。 -

短语节点与关系边: 将三元组中的实体(如“Steve Jobs”、“Apple”)作为短语节点,关系(如“co-founded”)作为关系边,构建知识图谱。