2.1 安装部署

每次进入 linux 都会自动进入 base 环境,如何关闭 base

conda deactivate 手动关闭

conda config --set auto_activate_base false 关闭自动进入2.1.1 集群规划

| bigdata01 | bigdata02 | bigdata03 |

| zk | zk | zk |

| kafka | kafka | kafka |

2.1.2 集群部署

0)官方下载地址:http://kafka.apache.org/downloads.html

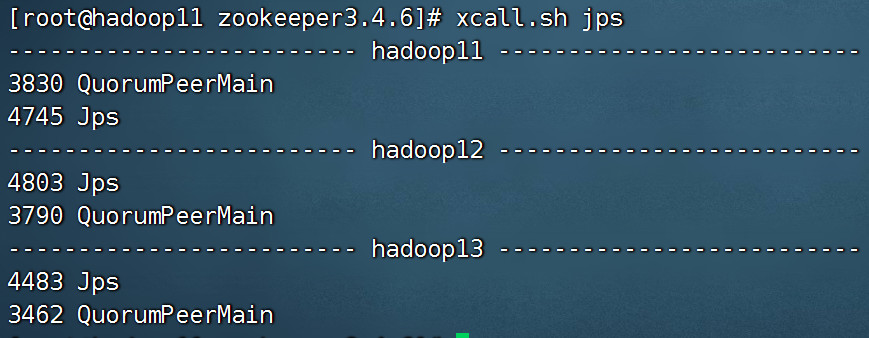

检查三台zk是否启动:

zkServer.sh start 默认启动方式

也可以使用脚本启动 zk.sh start

zk.sh脚本:

#!/bin/bash# 获取参数

COMMAND=$1

if [ ! $COMMAND ]; thenecho "please input your option in [start | stop | status]"exit -1

fi

if [ $COMMAND != "start" -a $COMMAND != "stop" -a $COMMAND != "status" ]; thenecho "please input your option in [start | stop | status]"exit -1

fi# 所有的服务器

HOSTS=( bigdata01 bigdata02 bigdata03 )

for HOST in ${HOSTS[*]}

dossh -T $HOST << TERMINATORecho "---------- $HOST ----------"zkServer.sh $COMMAND 2> /dev/null | grep -ivh SSLexit

TERMINATOR

done

编写完后,给脚本添加权限:

chmod 777 zk.sh

1)解压安装包

![]()

https://archive.apache.org/dist/kafka/3.0.0/kafka_2.12-3.0.0.tgz(官网下载)

kafka中 2.12 是scala语言的版本,3.0.0是kafka版本

tar -zxvf kafka_2.12-3.0.0.tgz -C /opt/installs/2)修改解压后的文件名称

mv kafka_2.12-3.0.0/ kafka3版本号解读:2.12 是scala版本,3.0.0是kafka版本3)进入到/opt/installs/kafka3 目录,修改配置文件

cd config/

vi server.properties修改(需要修改)部分:#broker 的全局唯一编号,不能重复,只能是数字。broker.id=0(需要修改)#处理网络请求的线程数量num.network.threads=3#用来处理磁盘 IO 的线程数量num.io.threads=8#发送套接字的缓冲区大小socket.send.buffer.bytes=102400#接收套接字的缓冲区大小socket.receive.buffer.bytes=102400#请求套接字的缓冲区大小socket.request.max.bytes=104857600#kafka 运行日志(数据)存放的路径,路径不需要提前创建,kafka 自动帮你创建,可以配置多个磁盘路径,路径与路径之间可以用","分隔log.dirs=/opt/installs/kafka3/datas(需要修改)#topic 在当前 broker 上的分区个数num.partitions=1#用来恢复和清理 data 下数据的线程数量num.recovery.threads.per.data.dir=1# 每个 topic 创建时的副本数,默认时 1 个副本offsets.topic.replication.factor=1#segment 文件保留的最长时间,超时将被删除log.retention.hours=168#每个 segment 文件的大小,默认最大 1Glog.segment.bytes=1073741824# 检查过期数据的时间,默认 5 分钟检查一次是否数据过期log.retention.check.interval.ms=300000#配置连接 Zookeeper 集群地址(在 zk 根目录下创建/kafka,方便管理)zookeeper.connect=bigdata01:2181,bigdata02:2181,bigdata03:2181/kafka(需要修改)/kafka的意思是:在zk中创建一个文件夹叫做kafka4)分发安装包

xsync.sh kafka3/

scp /opt/installs/kafka3 root@bigdata02:/opt/installs5)分别在 bigdata02 和 bigdata03上修改配置文件/opt/installs/kafka/config/server.properties 中的 broker.id=1、broker.id=2

注:broker.id 不得重复,整个集群中唯一。

6)配置环境变量

(1)修改bigdata01的环境变量,增加如下内容:

#KAFKA_HOME export KAFKA_HOME=/opt/installs/kafka3

export PATH=$PATH:$KAFKA_HOME/bin分发一下:

xsync.sh /etc/profile(2)刷新一下环境变量。

xcall.sh source /etc/profile 7)启动集群

(1)先启动 Zookeeper 集群,然后启动 Kafka。 【如果启动过就跳过】

xcall.sh zkServer.sh start(2)依次在 bigdata01、bigdata02、bigdata03 节点上启动 Kafka。

先进入到kafka3 这个文件夹中,在三台服务器上分别运行启动命令:

bin/kafka-server-start.sh -daemon config/server.properties关闭集群 :

bin/kafka-server-stop.sh2.1.3 集群启停脚本

1)在/usr/local/sbin 目录下创建文件 kf.sh 脚本文件

vim kf.sh

2) 编写脚本

#! /bin/bash

case $1 in

"start"){for i in bigdata01 bigdata02 bigdata03doecho " --------启动 $i Kafka-------"ssh $i "source /etc/profile; /opt/installs/kafka3/bin/kafka-server-start.sh -daemon /opt/installs/kafka3/config/server.properties"done

};;

"stop"){for i in bigdata01 bigdata02 bigdata03doecho " --------停止 $i Kafka-------"ssh $i "source /etc/profile; /opt/installs/kafka3/bin/kafka-server-stop.sh"done

};;

esac3)添加权限

chmod u+x kf.sh如何使用:

kf.sh start

kf.sh stop注意:停止 Kafka 集群时,一定要等 Kafka 所有节点进程全部停止后再停止 Zookeeper 集群。因为 Zookeeper 集群当中记录着 Kafka 集群相关信息,Zookeeper 集群一旦先停止, Kafka 集群就没有办法再获取停止进程的信息,只能手动杀死 Kafka 进程了。

之通过WebServer查询天气预报)