自注意力机制是一种用于处理序列数据的技术,广泛应用于自然语言处理(NLP)和计算机视觉等领域。它允许模型在处理一个元素时,考虑到整个序列中的其他元素,从而更好地捕捉长距离依赖关系。

例子:理解句子中的词语关系

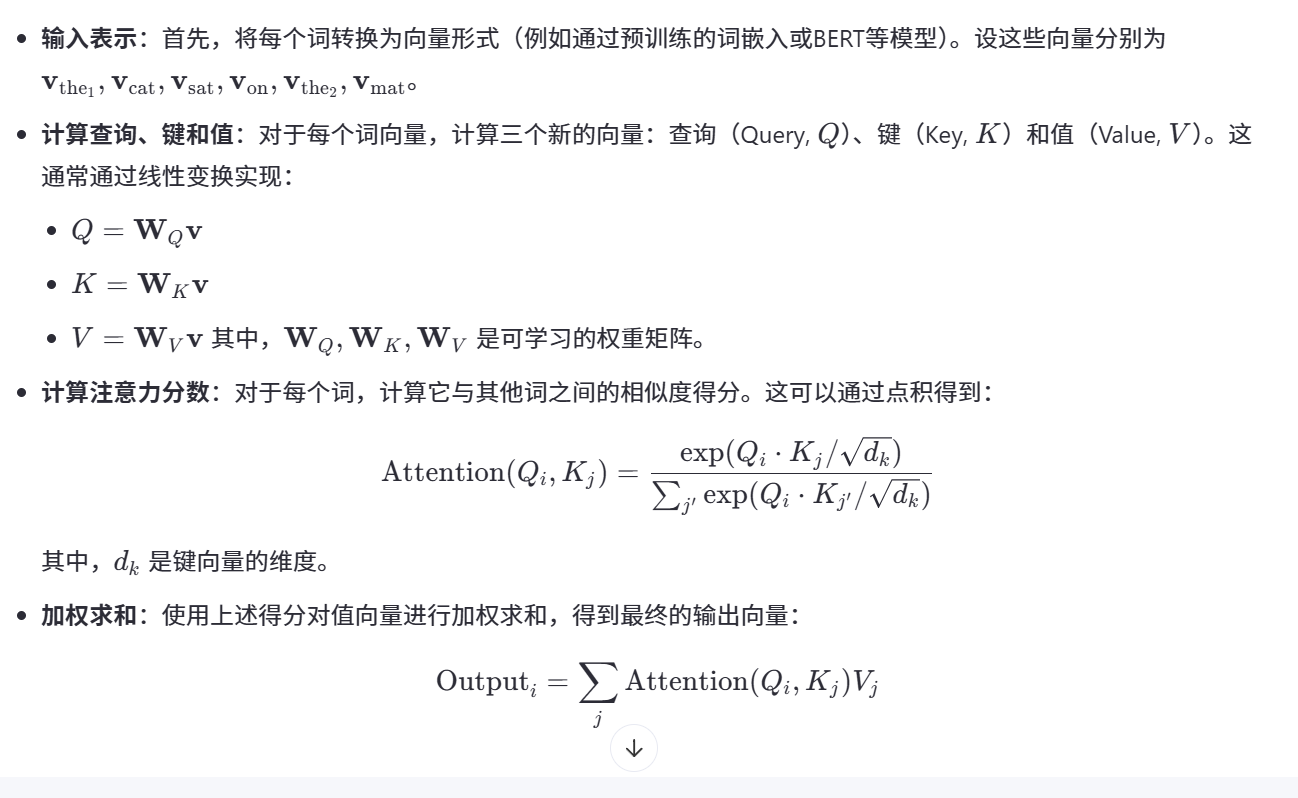

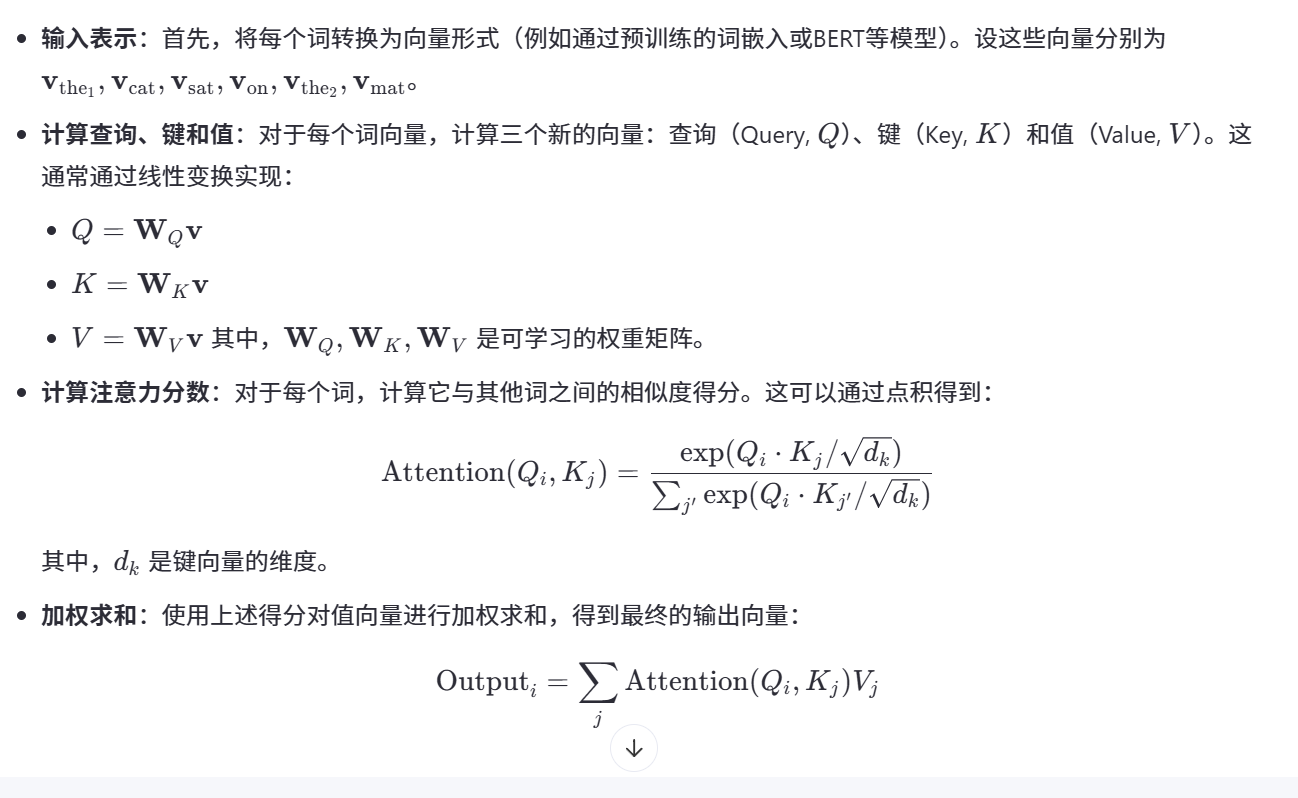

假设我们有一个句子:“The cat sat on the mat.” 我们的目标是理解每个词在这个句子中的意义,并找出它们之间的关系。

通过这种方式,模型可以动态地关注句子中最重要的部分,例如“cat”与“sat”的关系比“the”更为重要。

例子:理解句子中的词语关系

假设我们有一个句子:“The cat sat on the mat.” 我们的目标是理解每个词在这个句子中的意义,并找出它们之间的关系。

通过这种方式,模型可以动态地关注句子中最重要的部分,例如“cat”与“sat”的关系比“the”更为重要。

版权声明:

本网仅为发布的内容提供存储空间,不对发表、转载的内容提供任何形式的保证。凡本网注明“来源:XXX网络”的作品,均转载自其它媒体,著作权归作者所有,商业转载请联系作者获得授权,非商业转载请注明出处。

我们尊重并感谢每一位作者,均已注明文章来源和作者。如因作品内容、版权或其它问题,请及时与我们联系,联系邮箱:809451989@qq.com,投稿邮箱:809451989@qq.com