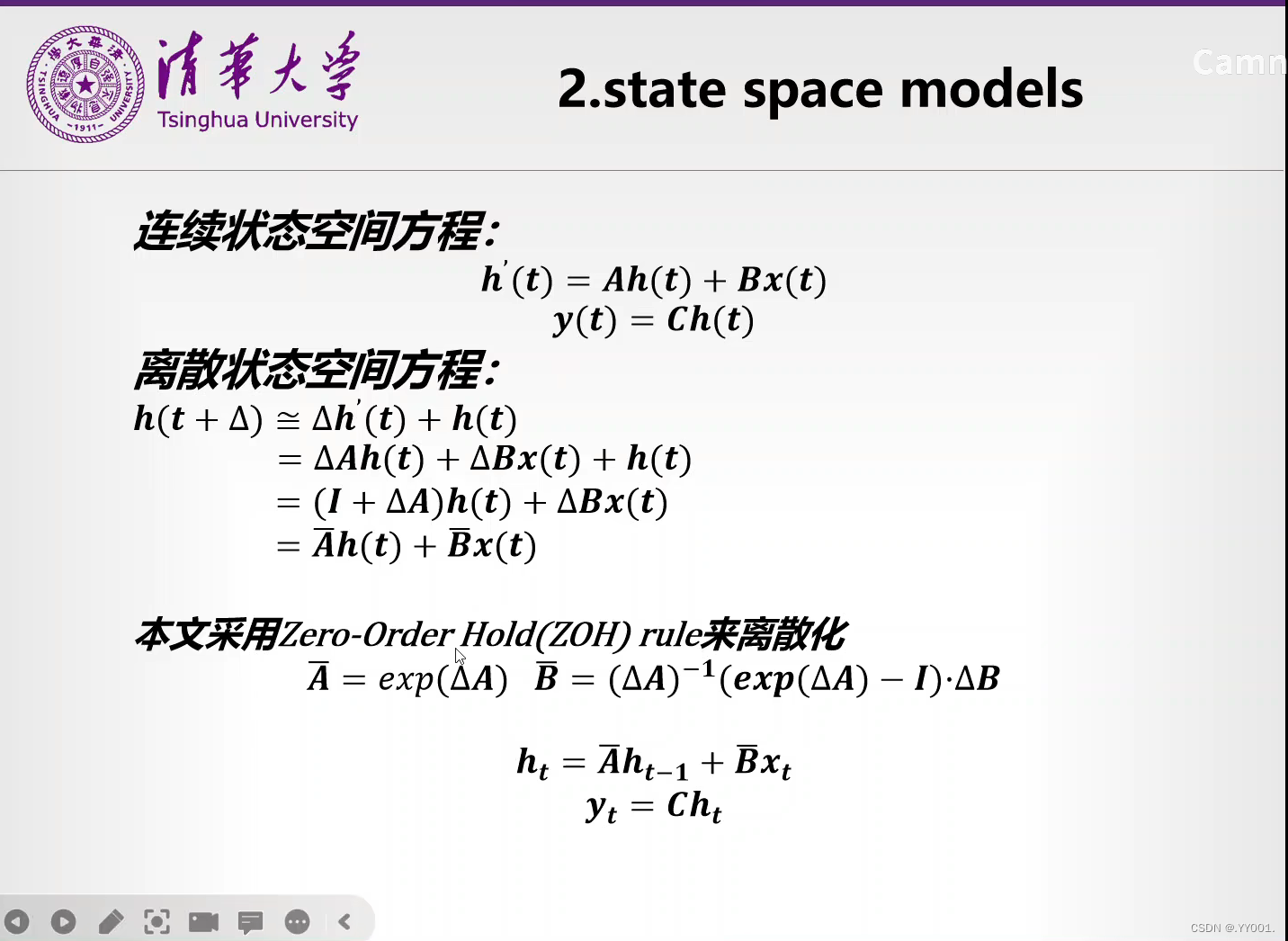

关于状态空间方程(state space models)

h(t)本身的状态参量,x(t)是这一时刻的输入

h‘(t)的导数就是与本身的状态以及输入有关.

y(t)就是输出

因为NLP是要处理离散的状态,所以要将连续的状态转换成离散的状态

关于这个zoh离散化

h(t)与h(t-1)前一时刻还有输入相关,其实可以看到在形式上与连续状态空间方程类似

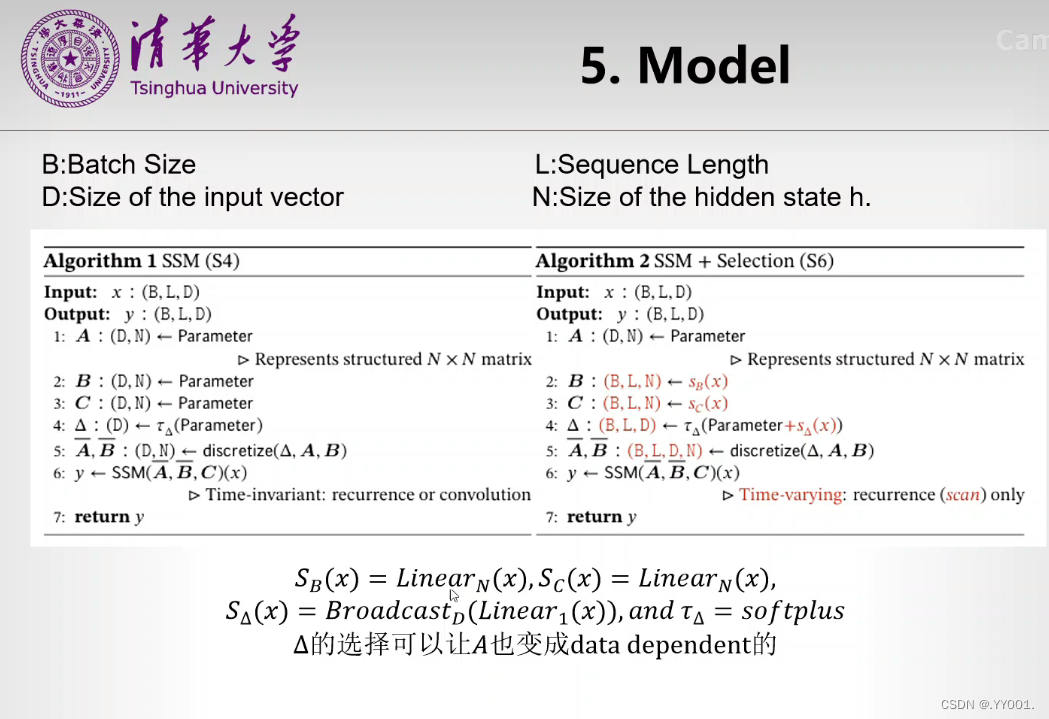

有个缺点:对于一个时间部,这里的ABC是一个固定的值 ,如果时间部不同,那么ABC也不同,那么就无法实现convolutional

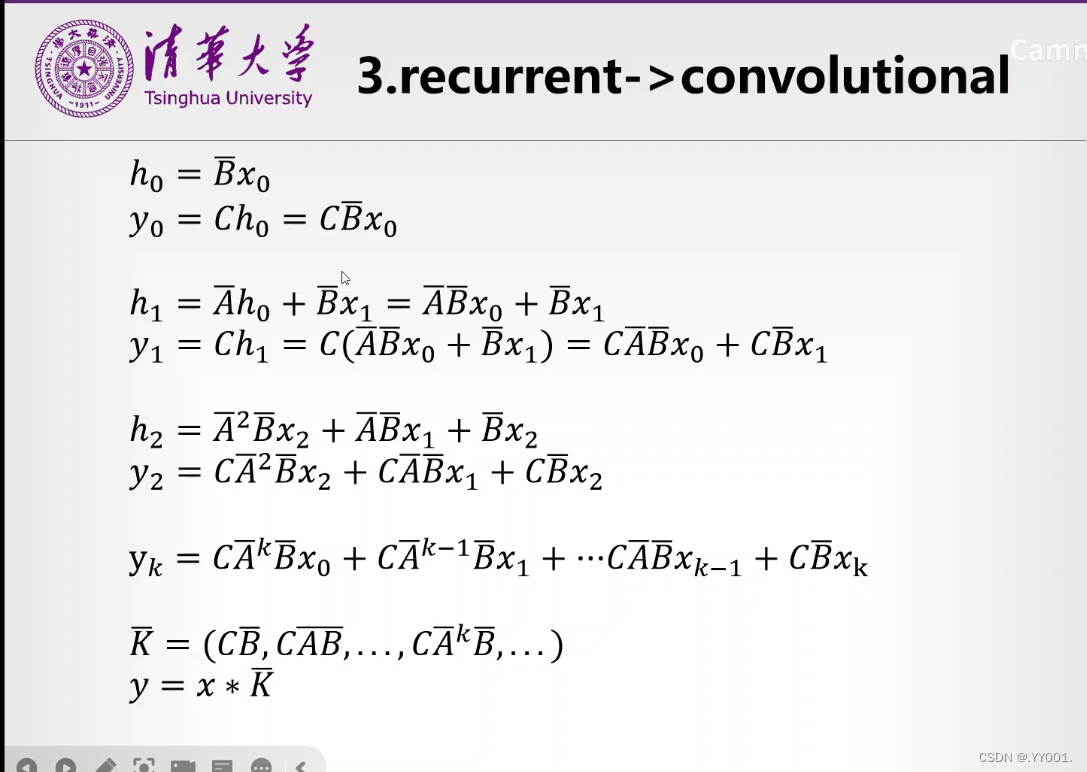

关于current和convolutional

- Current:通常指的是递归神经网络(Recurrent Neural Network, RNN)中的术语,它表示网络在处理序列数据时,当前步骤的输出会依赖于前面步骤的信息。RNN能够处理任意长度的序列数据,并且在每一步都维护一个内部状态,这个状态就是“current state”,它包含了前面的信息。

- Convolutional:指的是卷积神经网络(Convolutional Neural Network, CNN)中的术语,它表示网络通过卷积层来提取特征。在卷积层中,神经元会对输入数据的局部区域进行卷积操作,以此来捕捉局部特征。

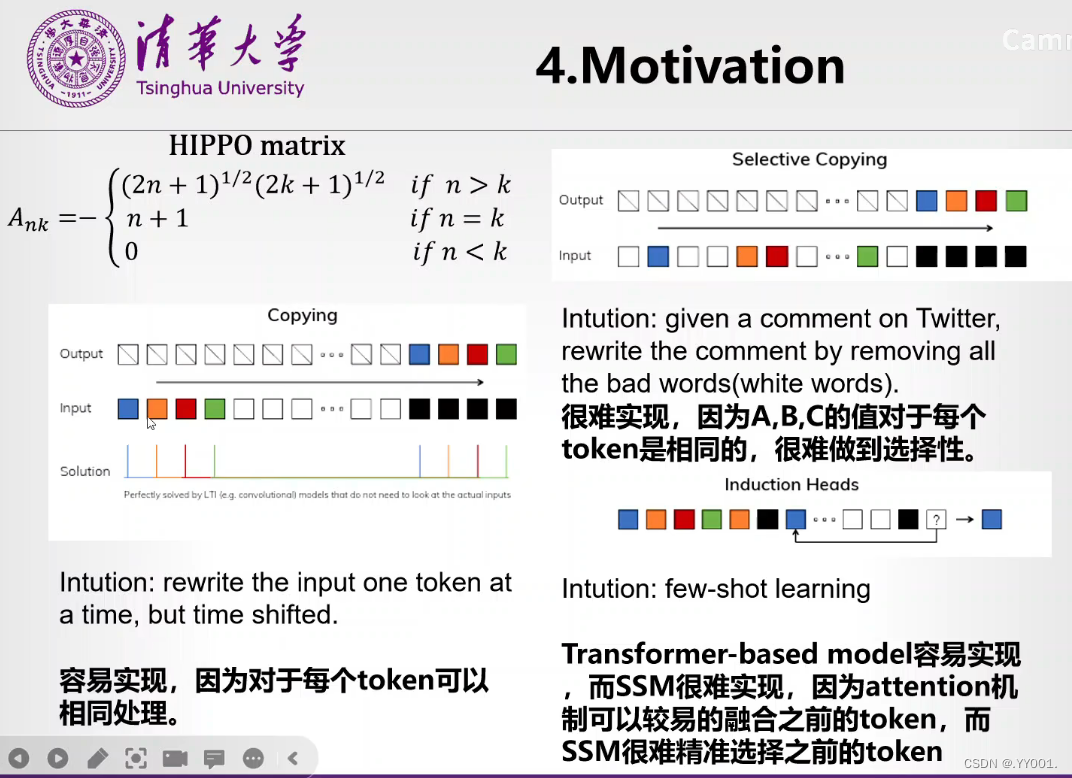

motivation

copy

输入是文本,我们要做的事是将文本中的单词copy到任意位置,这是简单的,因为对于同于一个token的ABC参数是一样的,因为我们可以对每个token采用相同参数处理

Token是文本中的最小单位,它可以是一个单词、一个标点符号或一个汉字。在处理文本数据时,模型会将输入文本拆分成一个个Token,每个Token都与一个唯一的数字ID相关联,这样模型就能够对其进行处理和理解。

selective copy

想把一些不相关的白色的词删去,但是因为每个token的ABC相同,很难有选择性,如果是transformer可以利用自注意力机制完成计算注意力分数,从而删除不相关的词语

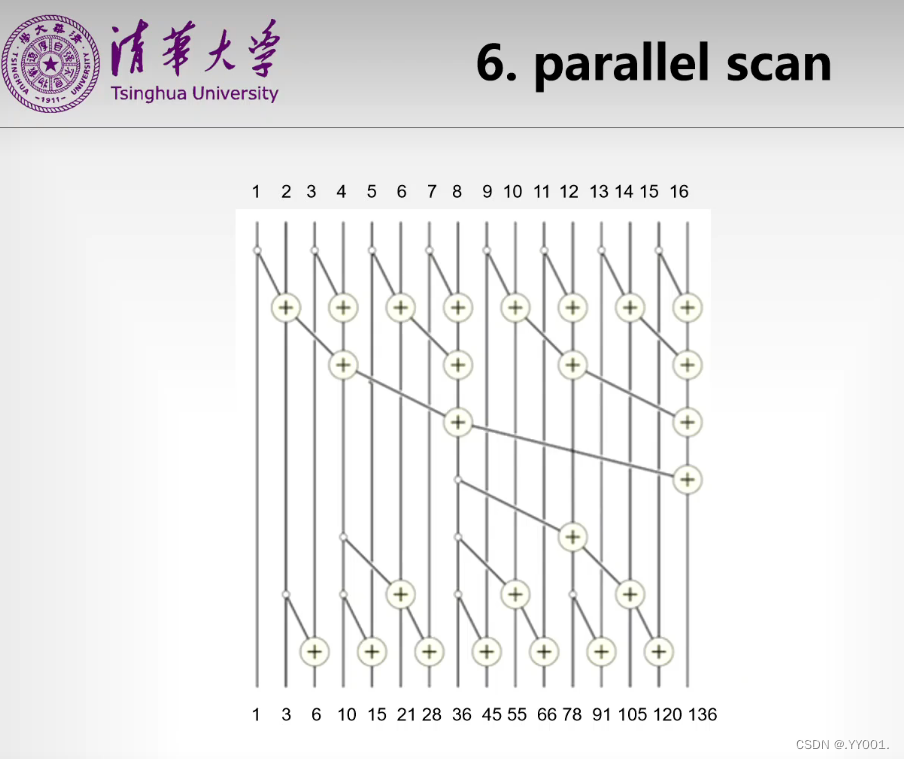

Parallel scan