- 模型规格

腾讯混元最新发布的开源模型Hunyuan-Large,是目前业界已开源的最大MoE(Mixture of Experts)模型之一。该模型拥有3890亿总参数和520亿激活参数,最大上下文长度达到128K。当前API版本暂时支持32K上下文。

二、费用结构(32K版本API)

- 输入费用:4元/百万tokens

- 输出费用:12元/百万tokens

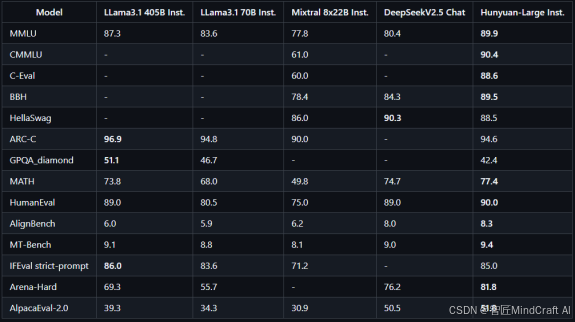

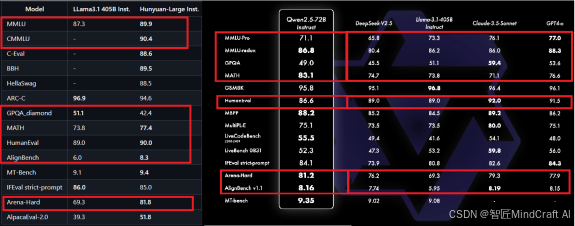

- 性能评测

根据提供的评测报告,Hunyuan-Large在多项指标上领先于Llama3.1-405B。与Qwen2.5 72B相比,在重叠的测试指标中,Hunyuan-Large表现出一定的优势,但在数学方面仍略逊于Qwen2.5 72B。总体而言,Hunyuan-Large在综合性能上优于Llama3.1、GPT-4o和Claude3.5 Sonnet。

-

- 模型使用

用户可以通过PC客户端和手机小程序使用Hunyuan-Large模型。

-

- API使用

登录开发者平台,进入接口文档,在LLM调用页面参考调用代码,可选择hunyuan-large。