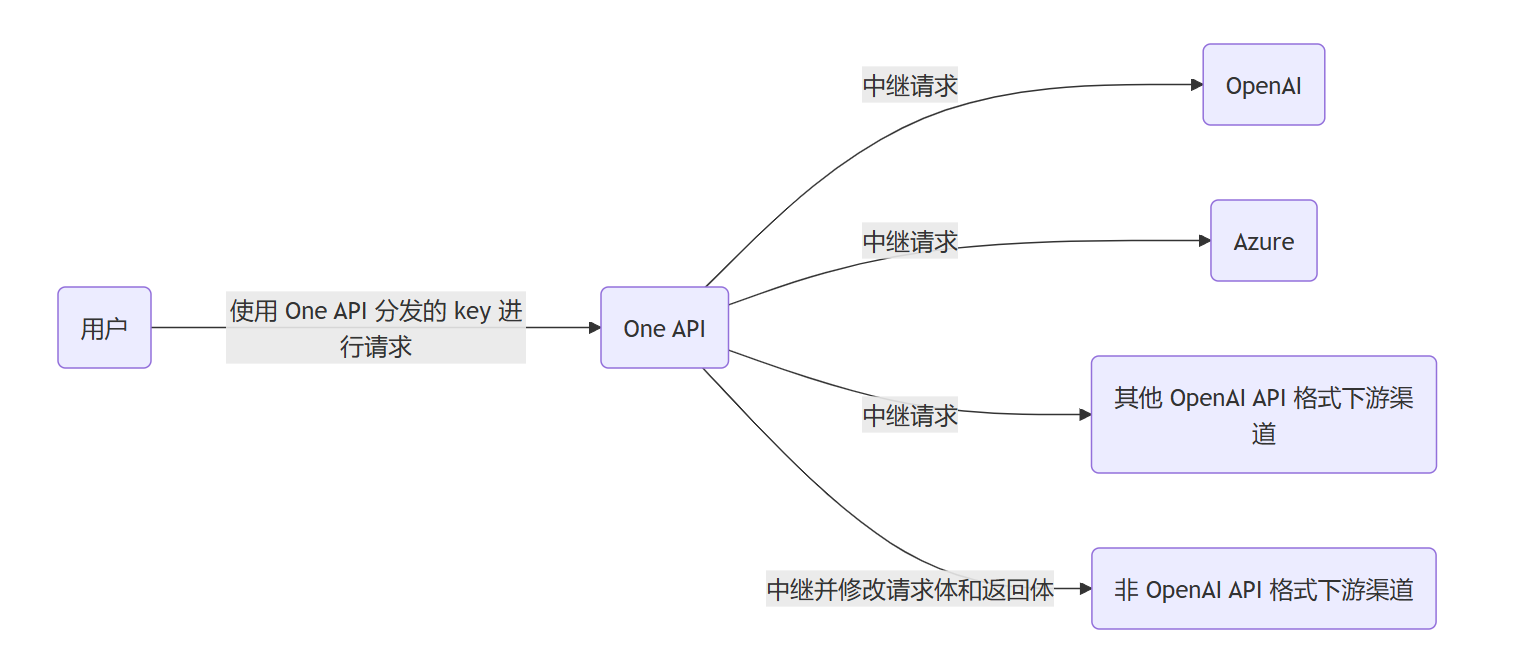

随着人工智能领域的不断发展,国内外各大厂商纷纷推出了自己的 AI 大模型。面对 DeepSeek、OpenAI、Claude、腾讯元宝等众多平台的 API 接口差异,开发者常常需要花费大量时间调整代码、处理密钥管理与流量调控。One API 正是在这种背景下诞生,它通过统一接口调用与全生命周期管理,成为了连接开发者与多模型服务的高效桥梁。

项目概述

One API 是一个开源的 AI 大模型 API 管理与分发系统,致力于解决多模型接入过程中面临的繁杂协议、密钥管理、流量分配等问题。它通过标准化接口(基于 OpenAI 格式)实现了不同大模型的无缝衔接。无论是 OpenAI、Google Gemini,还是国内的文心一言、讯飞星火等平台,开发者只需简单配置即可实现切换,旧代码无需大幅重构。

核心功能解析

统一接口调用

-

标准化格式:One API 将市面上 20+ 主流大模型的 API 接口协议转换为统一的 OpenAI 标准格式。开发者只需要更改

base_url参数,即可在本地部署的 ChatGLM3 与 gpt-3.5-turbo 之间自由切换。 -

开发便捷性:多模型接口标准化大幅降低了因不同平台 API 语法差异引起的开发调试成本,使项目集成与维护变得轻松高效。

多模型全生命周期管理

-

密钥管理:支持集中存储多平台 API 密钥,可设定密钥有效期,并通过 IP 白名单控制访问安全,保证企业内部数据安全。

-

负载均衡:智能分配请求流量,例如将 80% 的流量导向低成本模型,既降低 API 使用成本,也提升整体系统稳定性。

-

监控审计:实时统计 Token 消耗、调用成功率,并记录完整请求日志,满足企业合规要求,为问题排查提供有力支持。

灵活部署与扩展

-

多种部署方案:One API 支持 Docker 一键部署(单机/集群)、本地部署及私有化模型接入(如通过 Ollama 集成 Llama3)。无论是个人开发者还是企业级用户,都能快速上手。

-

开源授权:采用 MIT 开源协议,支持二次开发与商业场景定制,极大地拓宽了项目应用范围。

-

生态集成:能够无缝对接 FastGPT、ChatGPT Next Web 等生态工具,为各类业务场景提供技术支持。

典型应用场景

企业级 AI 服务网关

通过 One API,企业可以统一管理内部使用的 OpenAI、Azure 及国产模型接口。借助多租户权限控制,不同部门或客户间的资源可实现有效隔离。例如,某大型企业仅需 5 分钟便可将内部知识库系统与私有 ChatGLM3 对接,轻松实现企业级 AI 服务的构建。

多模型效果对比测试

研究人员可以借助统一输入/输出格式,快速切换不同大模型(如 GPT-4 与通义千问)进行效果对比,确保实验变量唯一,从而大大提升测试效率与数据准确性。

低成本 AI 应用开发

利用负载均衡功能,个人开发者可以优先调用免费额度未耗尽的模型(例如 DeepSeek),在保证性能的同时有效控制成本,为初创项目提供了极具竞争力的解决方案。

技术架构与性能亮点

高性能后端

-

Go 语言开发:后端采用高性能 Go 语言编写,支持 10K+ QPS 高并发请求,并结合 Redis 缓存技术加速响应。

-

智能路由策略:依据模型名称进行精确匹配,支持优先级配置与故障自动切换,确保系统在异常情况下依然平稳运行。

跨平台兼容性

-

无缝对接:不仅能适配主流大模型平台,还可与 FastGPT、ChatGPT Next Web 等生态工具协同工作,形成完整的 AI 服务链条。

部署与使用指南

极简部署

One API 提供了多种安装方式,以下是两种常用的 Docker 部署命令示例:

# SQLite 轻量部署(测试环境)

docker run -d --name one-api -p 3000:3000 justsong/one-api# MySQL 生产环境部署

docker run -d -e SQL_DSN="root:密码@tcp(数据库IP:3306)/oneapi" -p 3000:3000 justsong/one-api

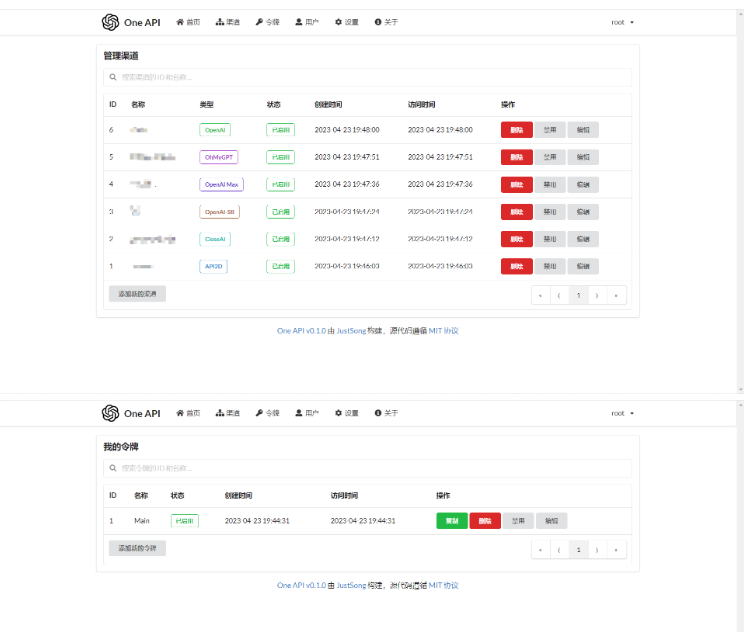

启动后,使用初始账号 root/123456 登录后台管理系统,首次登录时系统会强制修改密码。

模型接入示例

在管理后台中添加如讯飞星火等平台的 API 密钥,测试连通性无误后生成访问令牌,设置每日额度与 IP 白名单。开发者便可通过如下 Python 代码快速接入:

import openaiopenai.api_base = "http://one-api:3000/v1"

openai.api_key = "生成的令牌"response = openai.ChatCompletion.create(model="SparkDesk-v3.5", messages=[{"role": "user", "content": "Hello, One API!"}])

print(response)

管理界面直观易用,从密钥管理、令牌生成到日志监控,一切操作尽在掌握之中。

优劣势对比

优势

-

避免厂商锁定:统一接口调用方式使开发者可以灵活切换不同大模型,降低技术风险。

-

私有化部署:支持企业级私有化部署,数据安全更有保障。

-

降低成本:通过智能负载均衡功能,优化 API 调用成本,节省至少 30%+ 的使用开支。

-

高效管理:多模型全生命周期管理,大幅降低集成调试时间(可节省 50%+ 开发调试工作)。

挑战

-

运维成本:项目虽具备强大功能,但需要自行维护后端服务,企业需投入一定的运维资源。

-

手动适配:对于非 OpenAI 格式的 API,仍需手动进行适配工作。

-

依赖外部稳定性:系统性能在一定程度上依赖各大模型平台的 API 稳定性,需对外部故障进行快速响应。

生态与未来发展

One API 自上线以来,已在 GitHub 上获得 24.2K Star,并不断更新支持更多主流大模型(如最近新增的 Grok、智谱 AI 等)。其广泛的应用场景涵盖教育、金融、医疗等多个领域,如跨域知识库系统和智能客服中台均已成功落地。未来,项目将继续强化智能路由、负载均衡等核心技术,并探索更多跨平台生态整合,力争成为 AI 服务领域的标杆产品。

![高级java每日一道面试题-2025年3月22日-微服务篇[Nacos篇]-Nacos的主要功能有哪些?](http://pic.xiahunao.cn/nshx/高级java每日一道面试题-2025年3月22日-微服务篇[Nacos篇]-Nacos的主要功能有哪些?)