摘要

结构化文档理解在智能文档处理中的重要作用使其近年来引起了广泛关注,并取得了显著进展。然而,大多数现有的相关模型只能处理包含在预训练集合中的特定语言(通常是英语)文档数据,这极为有限。为了解决这一问题,我们提出了一种简单而有效的语言独立布局转换器(LiLT),用于结构化文档理解。LiLT可以在单一语言的结构化文档上进行预训练,然后直接在其他语言上通过相应的现成单语/多语预训练文本模型进行微调。对八种语言的实验结果表明,LiLT能够在各种广泛使用的下游基准任务上实现具有竞争力甚至优越的性能,这使得文档布局结构的预训练能够在语言上独立受益。代码和模型已公开,网址为 https://github.com/jpWang/LiLT。

1 引言

结构化文档理解(SDU)旨在读取和分析扫描/数字化文档中包含的文本和结构化信息。随着数字化进程的加速,它已被视为智能文档处理的关键部分,并被许多实际应用所需求,涵盖了金融、医疗和保险等多个行业。

最近,受到预训练语言模型(如Devlin等人,2019年;Liu等人,2019年b;Bao等人,2020年;Chi等人,2021年)的快速发展的启发,许多关于结构化文档预训练的研究(如Xu等人,2020年,2021年a,b;Li等人,2021年a,b,c;Appalaraju等人,2021年)也推动了多种SDU任务的极限。然而,几乎所有的研究都只关注单一语言(通常是英语)文档的预训练和微调。对于其他语言而言,这种方法极为有限,尤其是在缺乏预训练结构化文档数据的情况下。

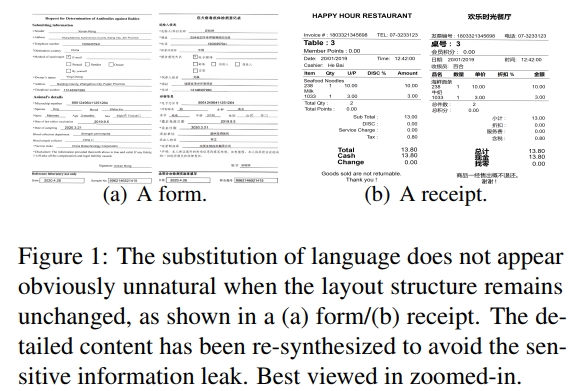

在这方面,我们考虑如何使结构化文档理解(SDU)任务从文档布局结构的预训练中受益,并且能够独立于语言。在这里,我们给出了一个观察,如图1所示。当布局结构保持不变时,语言的替换不会导致明显的不自然性。这充分激励我们解耦并重用不同语言之间的布局不变性。

基于这一启发,本文提出了一种简单而有效的语言独立布局转换器(LiLT),用于结构化文档理解。在我们的框架中,文本和布局信息首先在预训练期间解耦并联合优化,然后在微调过程中重新耦合。为了确保两种模态之间有足够的语言独立交互,我们进一步提出了一种新型的双向注意力补充机制(BiACM),以增强跨模态合作。此外,我们提出了关键点定位(KPL)和跨模态对齐识别(CAI)任务,它们与广泛使用的掩码视觉语言建模(MVLM)相结合,作为我们的预训练目标。在微调过程中,布局流(LiLT)可以与现成的预训练文本模型(如RoBERTa(Liu等人,2019b)、XLM-R(Conneau等人,2020)、InfoXLM(Chi等人,2021)等)分开并结合起来,用于处理下游任务。通过这种方式,我们的方法首先从单语结构化文档中解耦并学习布局知识,然后将其推广到多语种文档中。

据我们所知,唯一的现有多语言SDU模型是LayoutXLM(Xu等人,2021b)。它通过网络爬虫抓取了53种语言的多语言PDF文档,并引入了额外的预处理步骤来清理收集的数据、过滤低质量文档并将其分类为不同语言。之后,它利用启发式分布对2200万个多语言文档进行采样,这些文档进一步与从IIT-CDIP(Lewis等人,2006)数据集(1100万个英文文档)中采样的800万个英文文档结合起来,生成3000万个文档用于在LayoutLMv2(Xu等人,2021a)框架中进行预训练。然而,这一过程耗时且劳动密集。相反,LiLT只需要在IIT-CDIP上进行预训练,然后适应其他语言。在这方面,LiLT是首个用于结构化文档理解的语言独立方法。

在八种语言上的实验结果表明,LiLT可以在各种广泛使用的下游基准任务上实现具有竞争力甚至优越的性能,极大地促进了许多实际的SDU应用。我们的主要贡献可以总结如下:

- 我们提出了一种简单而有效的语言独立布局转换器LiLT,用于单语/多语结构化文档理解。

- 我们提出了BiACM,提供语言独立的跨模态交互,同时为文本和非文本流在预训练中的优化提供了一种有效的异步优化策略。此外,我们还提出了两个新的预训练目标,即KPL和CAI。

- LiLT在不同设置下,针对不同语言的各种广泛使用的下游基准任务中,表现出具有竞争力甚至优越的性能,充分证明了其有效性。

2 LiLT

图2展示了我们方法的整体框架。给定输入文档图像,我们首先使用现成的OCR引擎获取文本的边界框和内容。然后,文本和布局信息分别进行嵌入,并输入到相应的基于Transformer的架构中以获得增强的特征。引入双向注意力补充机制(BiACM)来完成文本和布局线索的跨模态交互。最后,编码后的文本和布局特征被连接在一起,并在其上添加额外的头部,用于自监督预训练或下游微调。

2.1 模型架构

整个框架可以看作是一个并行的双流Transformer。布局流与文本流共享类似的结构,除了隐藏层大小和中间层大小有所减少,以提高计算效率。

2.1.1 文本嵌入

按照常见的做法(Devlin等人,2019年;Xu等人,2020年),在文本流中,首先将OCR结果中的所有文本字符串进行分词,并通过将对应的文本边界框从左上角到右下角排序来连接成一个序列 S t S _ { t } St。直观地,特殊标记 [CLS] 和 [SEP] 也分别添加到序列的开头和结尾。之后, S t S _ { t } St会被截断或用额外的 [PAD] 标记进行填充,直到其长度等于最大序列长度 N。最后,我们将 S t S _ { t } St的标记嵌入 E t o k e n E _ { t o k e n } Etoken和一维位置嵌入 P 1 D P _ { \mathrm { 1 D } } P1D相加,得到文本嵌入 E T ∈ R N × d T E _ { T } \in \mathcal { R } ^ { N \times d _ { T } } ET∈RN×dT,如下所示:

E T = L N ( E t o k e n + P 1 D ) , ( 1 ) E _ { T } = \mathrm { L N } ( E _ { t o k e n } + P _ { \mathrm { 1 D } } ) , \qquad{(1)} ET=LN(Etoken+P1D),(1)

其中, d T d _ { T } dT是文本特征维度,LN 是层归一化(Ba等人,2016年)。

2.1.2 布局嵌入

至于布局流,我们使用相应的文本边界框构建一个与标记序列 S t S _ { t } St长度相同的二维位置序列 S l S _ { l } Sl。具体来说,我们将所有框的坐标归一化并离散化为 [0, 1000] 范围内的整数,并使用四个嵌入层分别生成 x 轴、y 轴、高度和宽度特征。给定归一化的边界框 B = ( T m i n , Z m a r , U m i n , U m a z , w i d t h , h e i g h t ) B = (Tmin, Zmar, Umin, Umaz, width, heig

(Go语言版))

:5G NR通信频带划分与应用场景)