1.新建普通用户dmx(可选)

[root@node3 ~]$ useradd dmx

2.切换普通用户dmx环境(可选)

[dmx@node3 ~]$ su - dmx

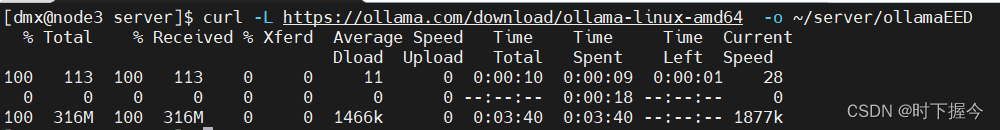

3.下载ollama-linux-amd64服务

下载ollama-linux-amd64到 ~/server目录,并将ollama-linux-amd64服务重命名为ollamaEED

curl -L https://ollama.com/download/ollama-linux-amd64 -o ~/server/ollamaEED

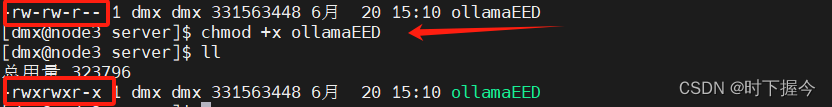

4.ollamaEED文件赋可执行权限

切换到~/server目录,赋予ollamaEED服务可执行权限

chmod +x ollamaEED

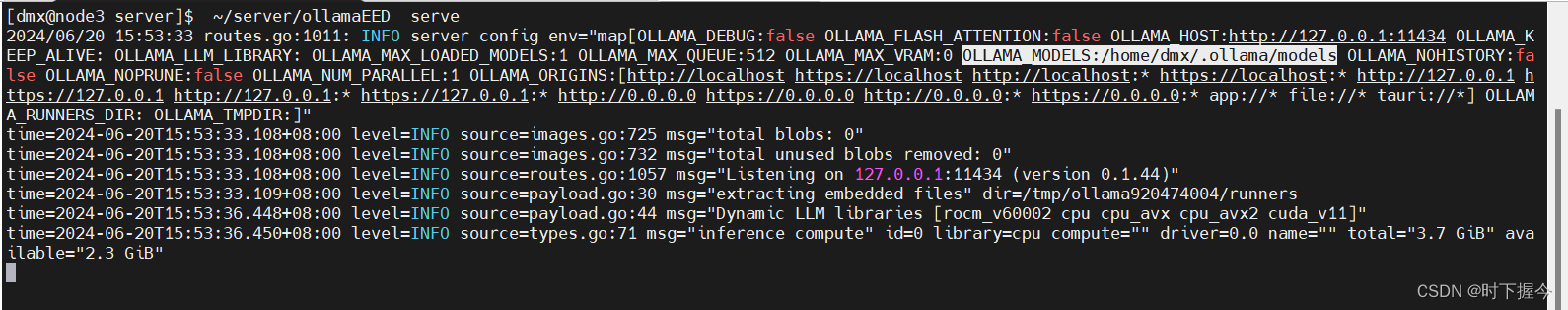

5.临时启动ollamaEED

如果只想启动一次,会话窗口标签页关闭后,服务也关闭,

执行命令

~/server/ollamaEED serve

会话窗口会直接显示启动日志

日志中,模型文件默认存储目录位于: 家目录/.ollama/models

ollamaEED默认监听端口:11434

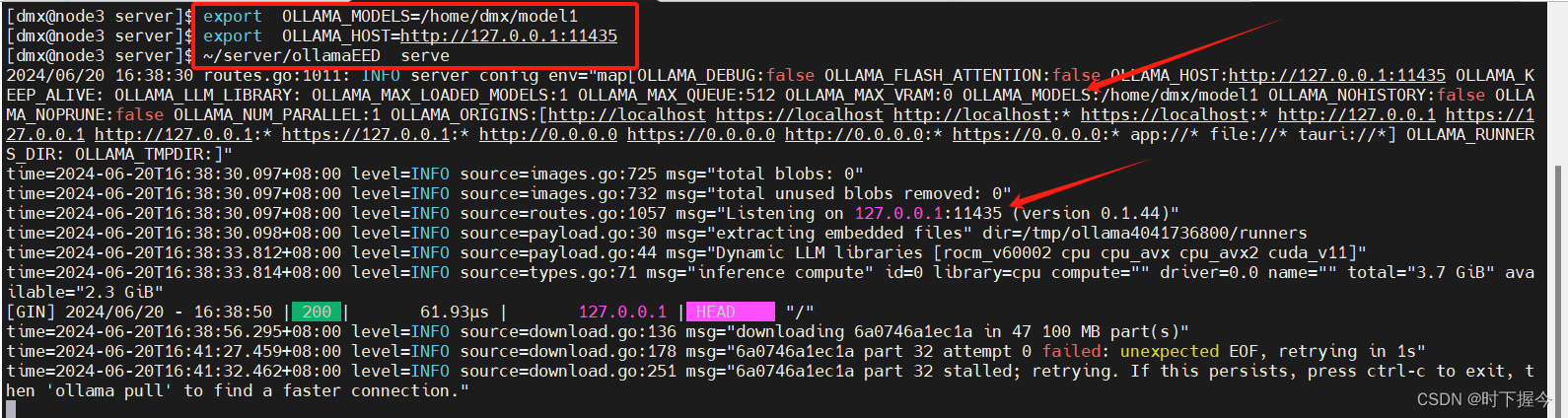

6.临时修改模型文件存储目录和监听端口(可选)

启动ollamaEED服务时,通过export命令,指定模型文件存储位置 和 ollamaEED 服务的监听端口(指定了监听端口,可以在同一台主机启动多个ollama服务)

首先手工创建/home/dmx/model1目录,然后执行export命令

export OLLAMA_MODELS=/home/dmx/model1

export OLLAMA_HOST=http://192.168.88.163:11435

最后启动ollamaEED服务

~/server/ollamaEED serve

7.永久修改模型文件存储目录和监听端口(可选)

[dmx@node3 ~]$ vim ~/.bash_profile

[dmx@node3 ~]$ source ~/.bash_profile

8.永久启动ollamaEED

后台启动ollamaEED,会话窗口标签页关闭后,ollamaEED服务仍然启动着

nohup ~/server/ollamaEED serve> ollamaEED.log 2>&1 &

重定向符号,表示将标准输出 重定向到右边的 ollama.log文件

2 代表标准错误输出

&1 代表的是标准输出的文件描述符

2>&1 代表把错误输出也合并到标准输出的文件中

& 代表将命令放到后台执行

9.永久模式启动的ollamaEED服务关闭

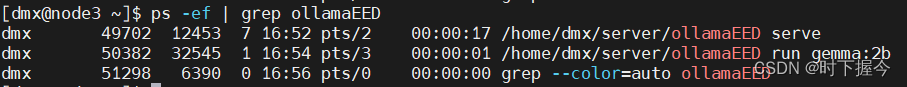

[dmx@node3 ~]$ ps -ef | grep ollamaEED

[dmx@node3 ~]$ kill 49702

49702为ollamaEED服务启动的进程号

10.ollamaEED工具 下载模型

[dmx@node3 ~]$ ~/server/ollamaEED pull llama3

更多资料