一、RNN

(一)简介

整个过程权重和偏置共享。

(二)梯度爆炸问题

在这个例子中w2大于1,会出现梯度爆炸问题。

当我们循环的次数越来越多的时候,这个巨大的数字会进入某些梯度,步长就会大幅增加,导致寻找最佳参数困难。另外会导致第一个输入的值影响越来越显著。

(三)梯度消失问题

在这个例子中w2小于1,会出现梯度消失问题。

当我们循环的次数越来越多的时候,这个非常的数字会进入某些梯度,步长就会大幅减小,导致寻找最佳参数困难。

二、长短期记忆网络LSTM

(一)主要思想

不使用相同的反馈环连接,通过很久以前的事情和昨天的事情进行预测。而是使用两条独立的路径来对明天预测,一条用于长期记忆,另一条用于短期记忆。

(二)Sigmoid激活函数

(三)Tanh激活函数

(四)原理

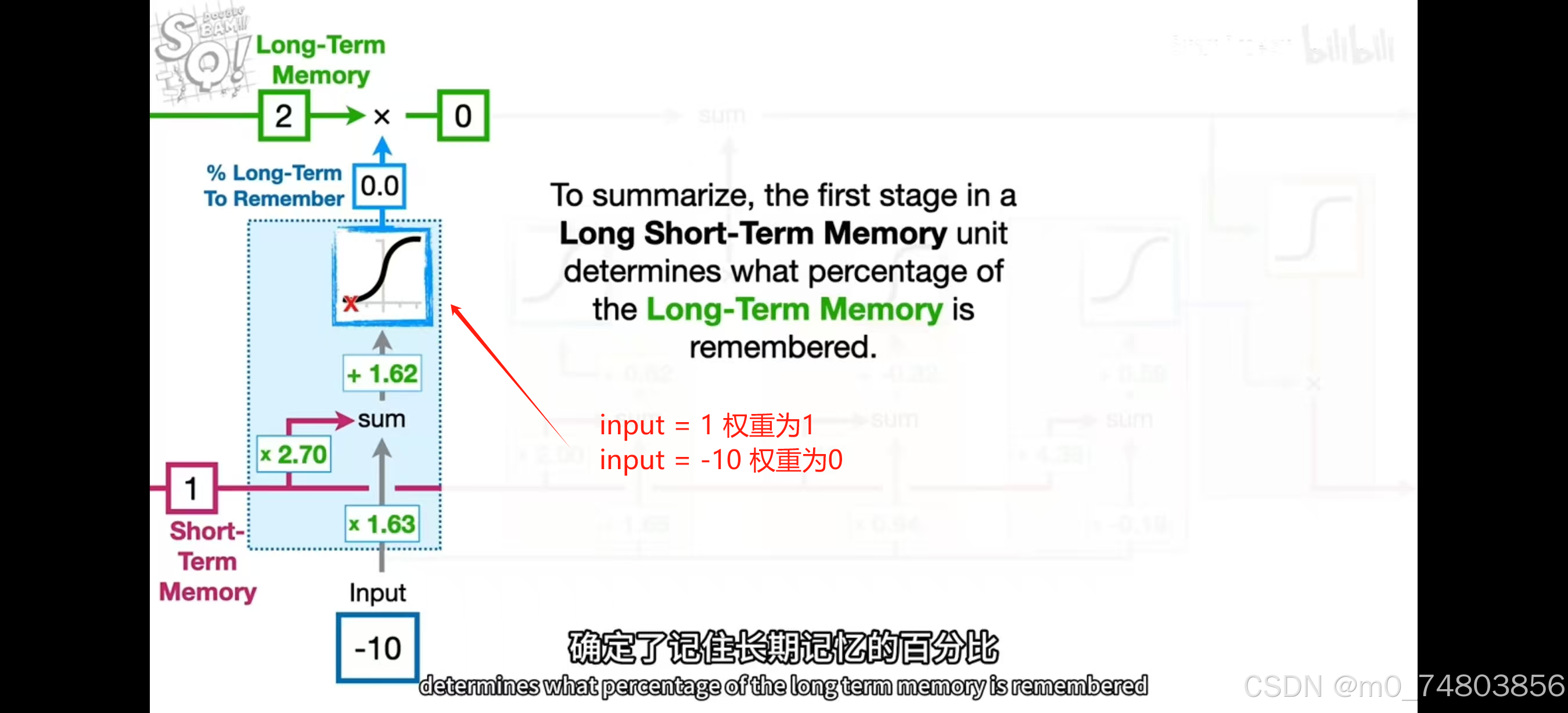

第一阶段“遗忘门”:确定记住旧长期记忆的百分比,得出长期记忆值。

第二阶段:“输入门”

右边模块:将短期记忆和输入结合(权重×数值),创建潜在的长期记忆。旧长期记忆+潜在的长期记忆 = 新的长期记忆

左边模块:确定这个潜在记忆中的权重。

第三阶段“输出门”:更新短期记忆。( 新长期通过激活函数计算潜在短期数值,再×权重 = 新的短期记忆)

具体表现请看:【官方双语】LSTM(长短期记忆神经网络)最简单清晰的解释来了! 第14:30处。

为什么通过LSTM能解决梯度爆炸和梯度消失的问题?

![[从零开始学习JAVA] 深入JAVA锁机制](http://pic.xiahunao.cn/nshx/[从零开始学习JAVA] 深入JAVA锁机制)