01 背景介绍

最近爆火的Deepseek,不仅在AI圈掀起地震,也掀起了全名AI的时代。AI正在深刻地改变生物行业,包括生物科技、制药、农业和医疗健康等领域。对于生物行业的我们,如何使用大模型高效地管理和利用生物学和内部知识,同时解决大模型专业应用方向的能力,成为了迫切需要解决的问题。

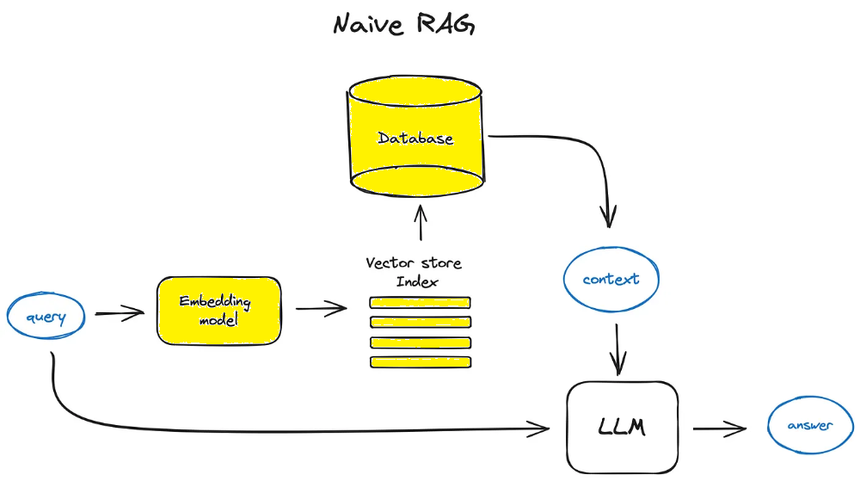

由于大模型的构建需要高性能GPU才能完成,Retrieval-Augmented Generation (RAG)技术应运而生。它是一种结合了信息检索(retrieval)和文本生成(generation)的混合方法,旨在通过利用大规模文本数据库中的相关信息来增强生成模型的表现。这种方法特别适用于需要高精度、上下文丰富回答的任务,如问答系统、对话系统等。能够从大规模知识库中检索相关信息并生成高质量的反馈。

RAG 模型的工作流程可以分为两个主要阶段:检索阶段和生成阶段。由于直接引用了具体、准确的数据源,因此对于事实性问题的回答通常更加可靠,减少大模型幻觉。可以追踪到具体的来源,便于验证结果的真实性。能够处理多样化的任务类型,包括问答、摘要等。

02 RAG系统搭建

2.1 Ollama下载安装

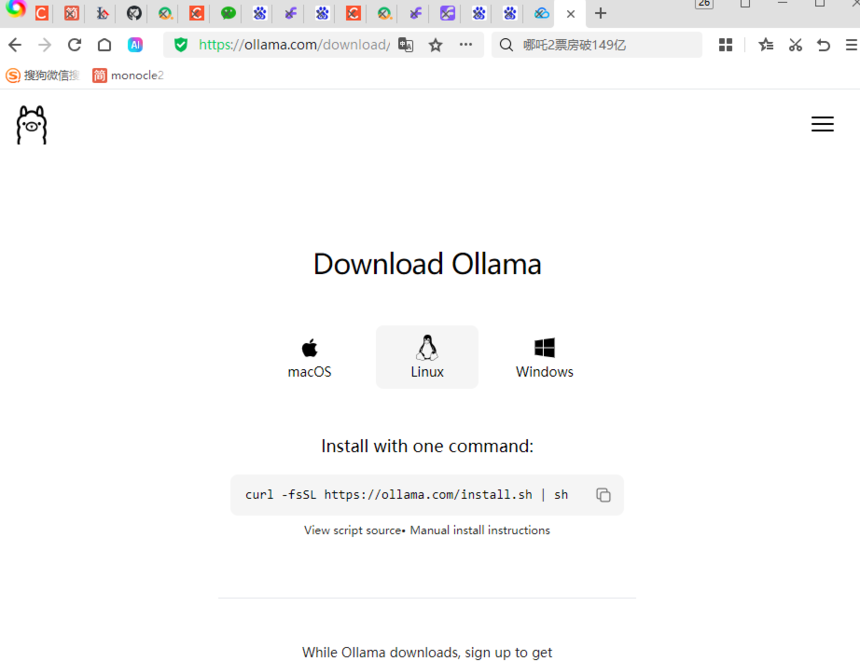

Ollama是一个开源框架,专为在本地机器上便捷部署和运行大型语言模型(LLM)而设计。进入Ollama的官方网站https://ollama.com/,下载适合你操作系统的安装包。

windows版点击安装即可,Linux版执行下面的命令自动安装。

curl -fsSL https://ollama.com/install.sh | sh

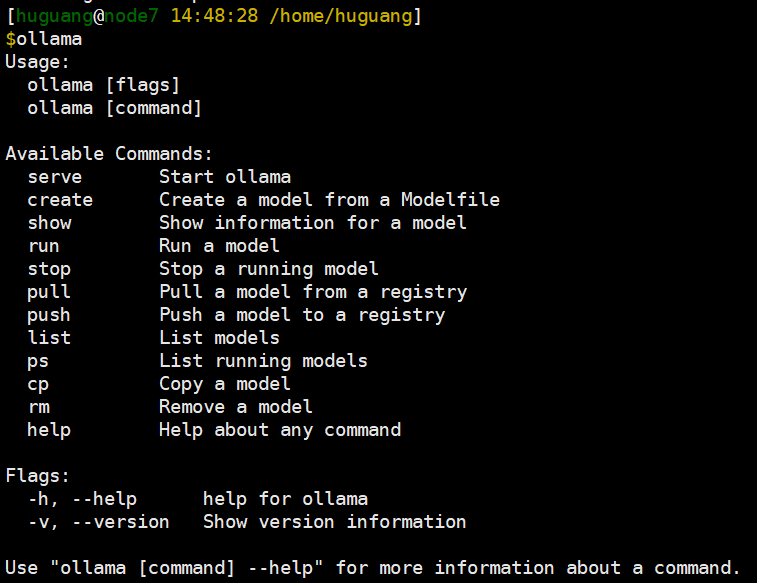

打开终端或命令行,输入ollama,出现如下帮助信息即代表安装成功。

2.2 Ollama 模型下载

从Ollama的官方网站下载DeepSeek R1 8b模型文件。首次使用需要先下载新模型,如果已经使用过则直接运行。

ollama run deepseek-r1:8b

Ollama默认只允许127.0.0.1:11434访问,我们可以修改配置,让所有IP都可以访问。修改文件:/etc/systemd/system/ollama.service,在[Service]这块最下面新增

Environment="OLLAMA_HOST=0.0.0.0"Environment="OLLAMA_ORIGINS=*"

保存

重启Ollama服务

systemctl daemon-reloadsystemctl enable ollama

再下载一个语义向量嵌入模型。后面做知识库的时候会用到。

ollama pull nomic-embed-text

目前用得比较多的有BEG-v3和nomic-embed-text。

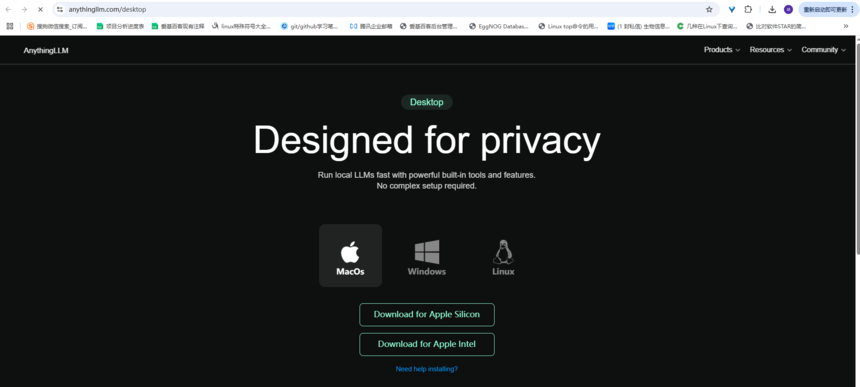

2.3 anythingLLM下载安装

进入官方下载链接,大家可以点击安装windows版自己使用即可。

由于我这边是Linux操作系统,并且只有Docker版本可以分享,所以我这边安装Docker版。

拉取官方Docker镜像

docker pull mintplexlabs/anythingllm

如果镜像拉不下来,则需要配置一下docker镜像源。创建/etc/docker/daemon.json文件,写入以下配置

{ "registry-mirrors": [ "https://mirror.ccs.tencentyun.com", "https://docker.m.daocloud.io" ]}

下载完成后执行下面的命令启动镜像。windows版本直接打开应用即可。这边使用的是3001端口,也可根据自己的个人需求修改。

export STORAGE_LOCATION="/var/lib/anythingllm" && \mkdir -p $STORAGE_LOCATION && \touch "$STORAGE_LOCATION/.env" && \docker run -d -p 3001:3001 \--cap-add SYS_ADMIN \-v ${STORAGE_LOCATION}:/app/server/storage \-v ${STORAGE_LOCATION}/.env:/app/server/.env \-e STORAGE_DIR="/app/server/storage" \mintplexlabs/anythingllm

windows版本安装好之后直接打开app,Linux通过IP地址加端口的方式访问。

注册登录,添加新工作区,就创建好了一个工作环境。

2.4 配置大模型

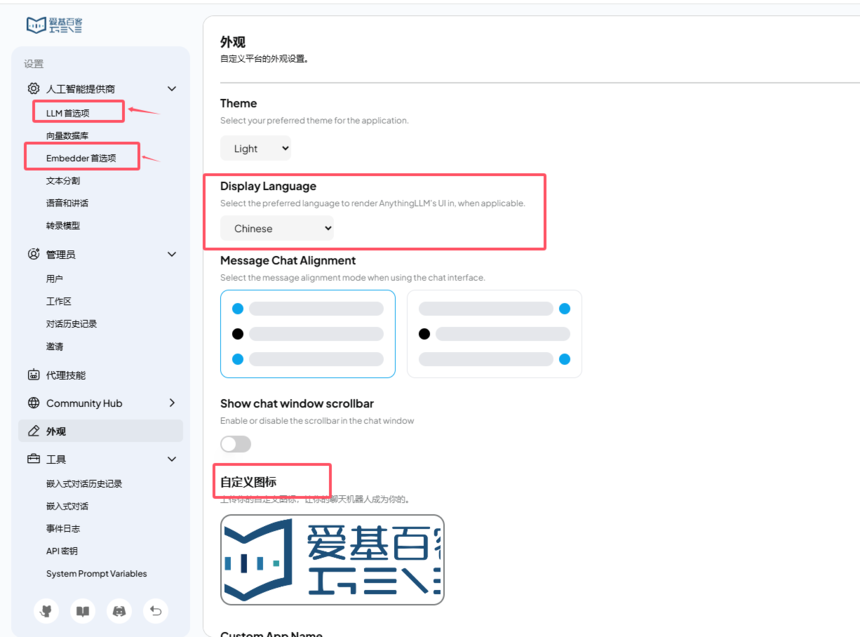

上面我们已经配置好了大模型运行环境Ollama,我们进入到全局设置里面进行配置。

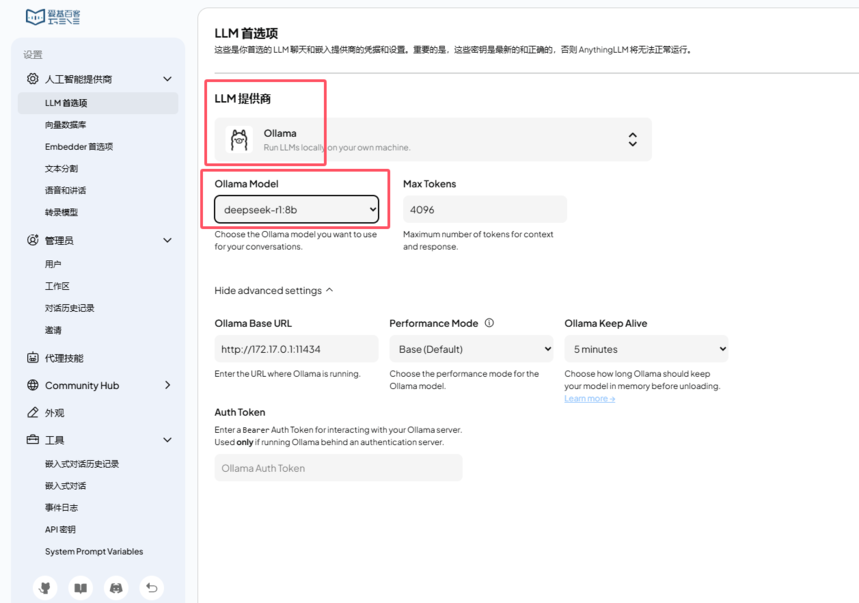

点击LLM首选项

LLM提供商选择Ollama,Ollama Model选择刚才配置好的deepseek-r1::8b模型,这样就配置好了。由于本地运行模型硬件资源有一定的要求。我们可以选择API连接来高效调用大模型。可以使用硅基流动提供的接口,也可以使用抖音火山方舟提供的接口,目前注册都有送token。

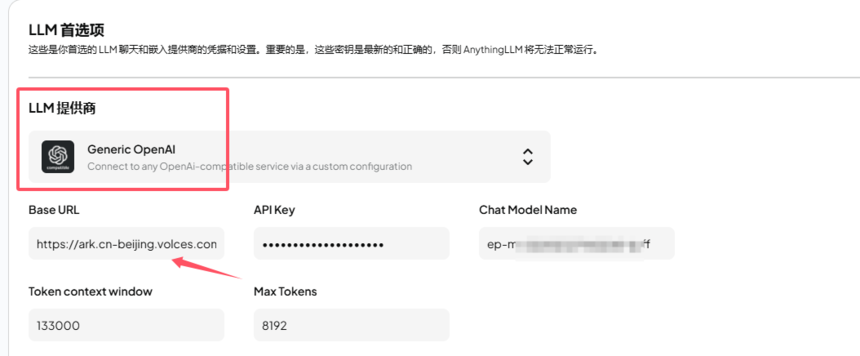

以火山方舟为列,填入如下信息。LLM提供商选择通用型openAI接口,如下所示输入官方提供的API key等信息。

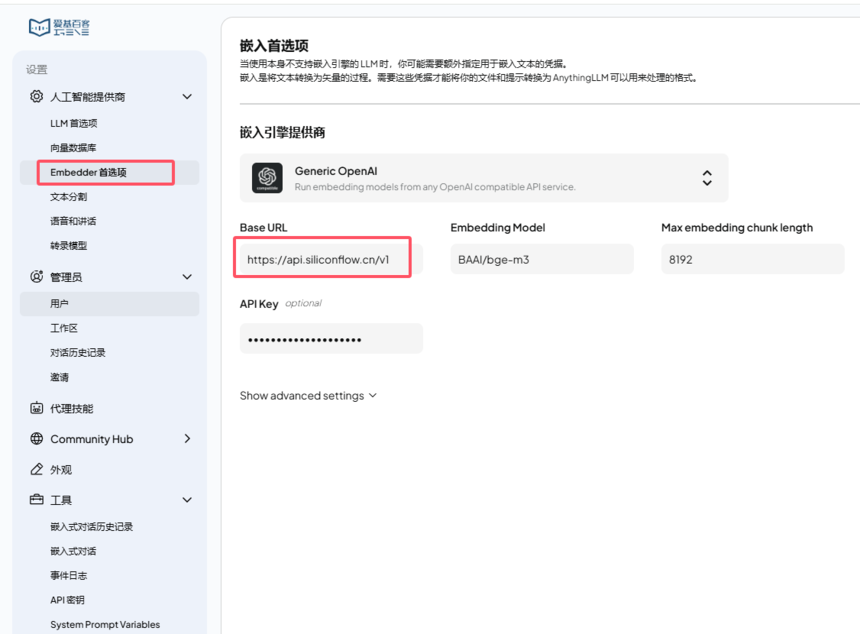

2.5 配置嵌入模型

向量数据库使用默认的LanceDB即可。这里可以使用前面下载好的嵌入模型nomic-embed-text。这里依然选择API接入的方式。使用硅基流动平台选择模型BEG-v3。

比较遗憾的是当前不支持reranker模型,期待后期官方更新。

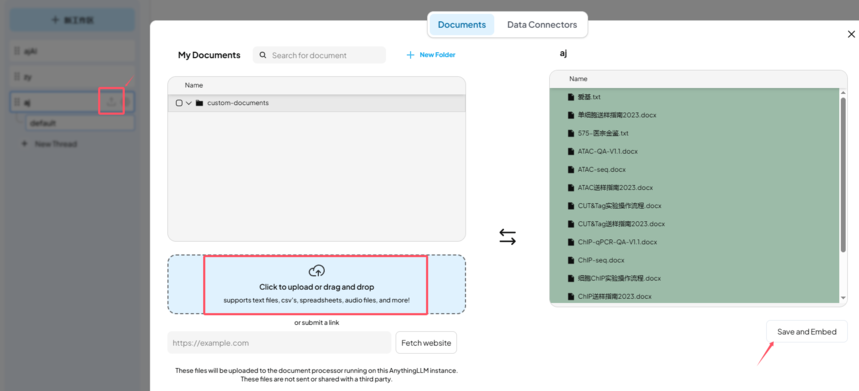

2.6 知识库构建

回到工作区主面板,点击工作区的文件上传按钮或者拖动文档。然后移动到工作区,点击Save and Embed等待。等待向量数据库构建完成即可使用。

2.7 使用与共享

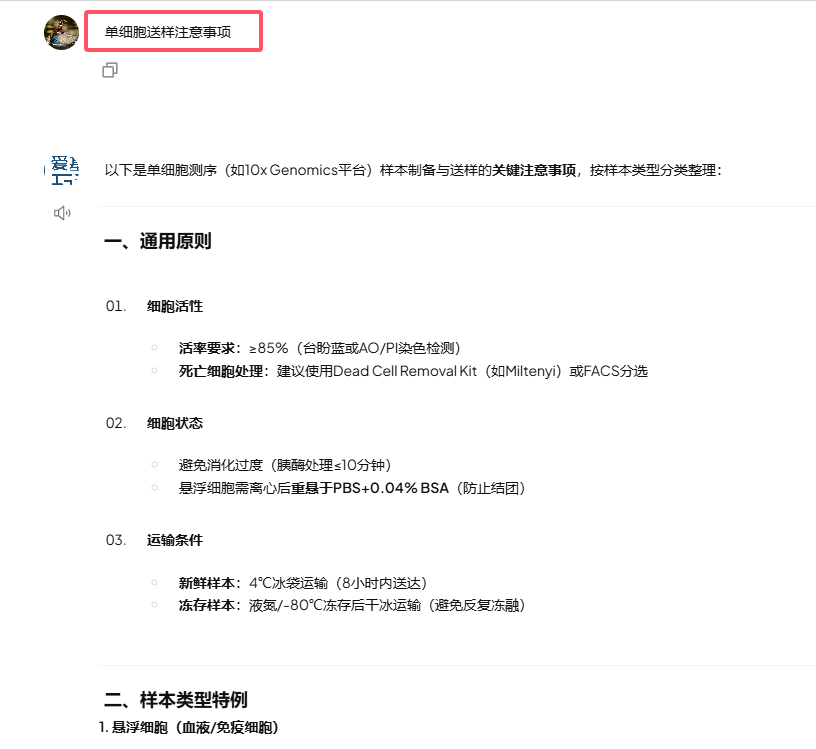

至此,所有相关配置均已完成,我们来测试一下效果。

再来一个问题

可以看到,回答还是比较全面的,综合了我们提供的知识文档。最后docker共享版还可以将工作区嵌入到网站共享使用。希望这篇文章能帮助大家构建自己的本地知识库。

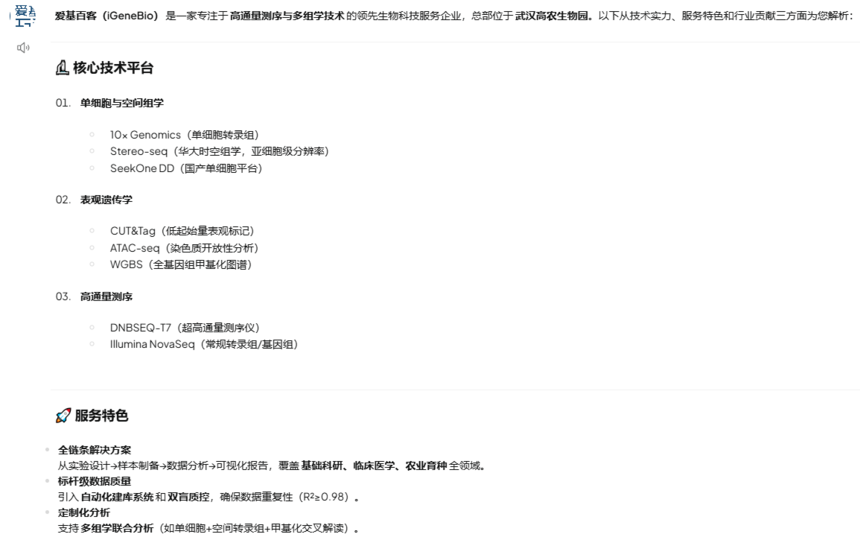

关于我们

武汉爱基百客生物科技有限公司(简称爱基百客)是一家专注于表观组学、单细胞时空组学和高通量测序分析服务的新型生物科技企业。公司办公面积逾3000m2,员工已达到百余人,业务覆盖全国,核心团队来自国内知名高校和基因测序公司。公司先后引入ChIP、ATAC-seq、CUT&Tag、单细胞(进口、国产多平台)、DNBSEQ-T7和STOmics时空组学等实验平台,同时配备MGISP-960和AlphaTool等自动化设备。

运营至今合作科研客户超2000家,涵盖国内知名科研院所、高校及相关企业。多项合作成果发表在Science、Cancer Cell、Circulation、Nature Communications和Plant Cell等国际顶级期刊,广受客户好评,成为国内成长最迅速的高通量测序科研服务企业之一。爱基百客将秉承服务至上的理念,发挥自身优势,期待与海内外科研学者精诚合作,共探生命百科全书。