💪 专业从事且热爱图像处理,图像处理专栏更新如下👇:

📝《图像去噪》

📝《超分辨率重建》

📝《语义分割》

📝《风格迁移》

📝《目标检测》

📝《暗光增强》

📝《模型优化》

📝《模型实战部署》

在深度学习训练过程中,batch_size 对训练时间的影响并不是线性的,有时增大 batch_size 反而会导致训练时间变长。

目录

- 一、例子

- 1.1 较大batch_size

- 1.2 较小batch_size

- 1.3 对比分析

- 二、原因

- 2.1 硬件限制

- 2.2 优化器的影响

- 2.3 数据传输瓶颈

- 2.4 模型的细节和配置

- 三、设置最合适batch_size值

- 四、总结

一、例子

1.1 较大batch_size

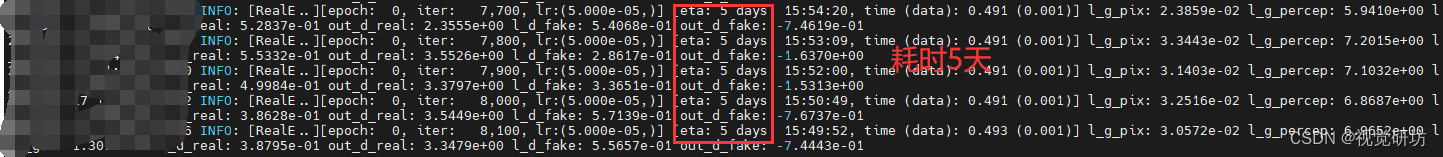

下面是batch_size设置较大为45时的耗时情况统计:

下面是训练过程中显存和GPU的利用情况:

下面是耗时情况:

1.2 较小batch_size

下面batch_size设置为20:

下面是训练过程中显存和GPU的利用情况:

下面是训练耗时情况统计:

1.3 对比分析

通过上面较大和较小的batch_size数值对比分析可以看出,较大的batch_size值不一定会加快训练速度,具体原因见下。

二、原因

2.1 硬件限制

内存限制: 当 batch_size 增大时,单次前向和反向传播所需的内存也增加。如果你的硬件(尤其是 GPU)内存不足,可能会导致频繁的数据交换,增加训练时间。

计算瓶颈: 大 batch_size 会使得计算量增加,尤其是当计算资源无法充分利用时,这种增加会变得显著。

2.2 优化器的影响

学习率与batch_size关系: 一些优化器在大 batch_size 下可能需要更高的学习率才能维持同样的收敛速度。如果学习率没有相应调整,可能导致训练速度变慢,甚至影响收敛效果。

梯度更新频率: 较小的 batch_size 意味着更频繁的梯度更新,这可能在某些情况下加快收敛速度。

2.3 数据传输瓶颈

数据读取与传输: 增大 batch_size 会导致每次训练迭代需要传输更多数据,这会增加数据读取和传输的时间。如果数据存储在磁盘或通过网络传输,这种影响会更加明显。

2.4 模型的细节和配置

模型架构复杂度: 对于某些复杂模型,增大 batch_size 可能导致训练时间成倍增加,因为每次迭代的计算时间大幅增加。

框架实现细节: 一些深度学习框架对大 batch_size 的优化不够充分,可能导致效率下降。

三、设置最合适batch_size值

监控内存使用情况: 观察在不同 batch_size 下的内存使用情况,确认是否存在内存瓶颈。

调整学习率: 尝试在大 batch_size 下调高学习率,观察是否有改善。

数据加载优化: 确保数据加载和传输的效率,避免因 I/O 瓶颈导致的训练时间增加。

实验记录: 详细记录不同 batch_size 下的训练过程,分析各个阶段的时间消耗,找到具体的瓶颈。

四、总结

以上就是深度学习训练中batch_size参数设置过大反而训练更耗时的原因分析,学者想要快速训练出模型,得根据自己具体的模型结构复杂程度,电脑性能等设置合适的batch_size参数。

感谢您阅读到最后!😊总结不易,多多支持呀🌹 点赞👍收藏⭐评论✍️,您的三连是我持续更新的动力💖

关注公众号「视觉研坊」,获取干货教程、实战案例、技术解答、行业资讯!